DeepMind ile yapay zekada insan değerlerini nasıl yeniden üreteceğinizi düşünün

Leifeng.com AI teknolojisi inceleme basını: Yapay zeka söz konusu olduğunda, insanlar nadiren Skynet'i, insan karşıtı sonuçlara götüren "süper insan zekası" na götüren kendine özgü düşünme mantığına sahip "Terminator" filminde düşünürler. Bu elbette iyi bir şey, hepimizin bildiğimizi gösteriyor ki bu aşamada yapay zekanın bu tür bir mantıksal düşünme yeteneğine sahip olmadığını ve mevcut doğrultuda gelişmeye devam etmeyeceğini; aynı zamanda çevremizde her türlü uygulama makinesinin olduğunu anladığımızı da gösteriyor. Belirli problemleri çözmenin teknik sonuçlarını öğrenin.

Ama aynı zamanda yeni bir sorunla karşı karşıyayız, yani insanlar daha fazla karar vermek için modelleri kullandıkça, modelin değer verdiği faktörler onu tasarlayan insanlarla gerçekten aynı mı? Veya model, tasarımcı tarafından sağlanan verilerdeki desenleri tamamen yakalar, ancak verilerin kendisi tasarımcının fark etmediği önyargıları içerir. Şimdi ne yapacağız?

DeepMind güvenlik ekibinin hazırladığı bu makale bazı tartışmalar yaptı ve ilgili konularda bazı bilgiler ortaya koydu. Yakın tarihli bir DeepMind makalesinde "Ödül modelleme yoluyla ölçeklenebilir ajan hizalaması: bir araştırma yönü" önerilen araştırma yönlerini özetlemektedir; bu makale "ajan hizalama" problemi için bir araştırma yönü sağlamaya çalışmaktadır. Sonuç olarak, ödül modellemeye dayalı yinelemeli bir uygulama yöntemi önerdiler ve makinenin gerçek dünyadaki karmaşık sorunları çözmeden önce kullanıcının niyetlerini tam olarak anlamasına izin verdi. Leifeng.com AI Technology Review aşağıdaki gibi derlenmiştir.

Son yıllarda, pekiştirmeli öğrenme birçok karmaşık oyun ortamında inanılmaz bir güç göstermiştir.Atari oyunları, Go, satrançtan Dota 2 ve StarCraft II'ye kadar, AI ajanları birçok karmaşık alanda insanları hızla geride bırakıyor. Araştırmacılar için oyunlar, makine öğrenimi algoritmalarını denemek ve test etmek için ideal bir platformdur.Oyunlarda, gerçek dünyadaki sorunları çözmek için gereken yeteneklerden farklı olmayan, görevleri tamamlamak için kapsamlı bilişsel yetenekler kullanılmalıdır. Buna ek olarak, makine öğrenimi araştırmacıları, öğrenim sistemi için sabit bir eğitim verisi akışı sağlamak üzere bulut üzerinde paralel olarak binlerce simülasyon deneyi çalıştırabilir.

En kritik nokta, oyunların genellikle net hedefleri ve görevleri ve hedefin ilerlemesini yansıtan bir puanlama sistemine sahip olmasıdır. Bu puanlama sistemi, sadece takviye öğrenme aracıları için etkili ödül sinyalleri sağlamakla kalmaz, aynı zamanda hangi algoritma ve çerçevenin en iyi performansı gösterdiğini belirlemek için hızlı bir şekilde geri bildirim almamızı sağlar.

Aracıyı insanla tutarlı hale getirin

Bununla birlikte, yapay zekanın nihai amacı, insanların gerçek hayatta giderek karmaşıklaşan zorluklarla başa çıkmalarına yardımcı olmaktır. Gerçek hayatta iyi bir ödül mekanizması yok Bu, yapay zekanın performansını değerlendirmek için insanlar için bir zorluk teşkil ediyor. Bu nedenle, YZ'nin insan niyetlerini tam olarak anlayabilmesi ve insanların hedeflerine ulaşmasına yardımcı olabilmesi için mümkün olan en kısa sürede ideal bir geri bildirim mekanizması bulmak gerekir. Başka bir deyişle, yapay zeka sistemini eğitmek için insan geri bildirimini kullanmayı umuyoruz, böylece davranışı niyetlerimizle tutarlı olabilir. Bu hedefe ulaşmak için, DeepMind araştırmacıları bir "aracı hizalama" problemini aşağıdaki gibi tanımladılar:

Davranışı kullanıcının niyetiyle tutarlı olan bir aracı nasıl oluşturulur?

Bu hizalama problemi pekiştirmeli öğrenme çerçevesinde özetlenebilir.Farkı, aracıların geleneksel sayısal ödül sinyalleri kullanmak yerine etkileşimli protokoller aracılığıyla kullanıcılarla iletişim kurması ve niyetlerini anlamasıdır. Etkileşimli protokole gelince, gösteri (Google'ın taklit öğrenme robotu gibi taklit öğrenme), tercih eğilimi (OpenAI ve DeepMind'ın bana yaparsınız değerlendirmesi gibi doğrudan insan değerlendirme sonuçları), en uygun eylem ve ödülleri iletme gibi birçok form olabilir. Fonksiyonlar vb. Genel olarak, Akıllı vücut hizalama probleminin çözümlerinden biri, makinenin kullanıcının niyetine göre çalışmasına izin veren bir strateji oluşturmaktır.

DeepMind'in "Ödül modelleme yoluyla ölçeklenebilir ajan hizalaması: bir araştırma yönü" başlıklı makalesi, "ajan hizalama" problemini olumlu bir şekilde çözmek için bir araştırma yönünü özetlemektedir. DeepMind, AI güvenlik sorunlarının sınıflandırılmasında yapılan çalışmaya ve geçmişte AI güvenlik sorunlarının detaylandırılmasına dayanarak, herkese akıllı vücut hizalama sorununa bir çözüm bulmaya ve verimli bir iletişim kurmaya teşvik etmek için bu alanlarda şimdiye kadar kaydedilen ilerlemeyi açıklayacak. Kullanıcı geri bildirimlerinden öğrenen ve kullanıcı tercihlerini doğru bir şekilde tahmin edebilen bir sistem. İster şu anda görece basit görevlerle, ister giderek daha karmaşık, soyut hale gelecek ve hatta gelecekte insan anlayışının ötesine geçecek görevlerle uğraşıyor olsun, sistemin yetenekli olacağından fazlasını umuyorlar.

Ödül modelleme yoluyla uyum

DeepMind'ın araştırma yönünün özü, Ödül modelleme . Önce kullanıcı geri bildirimini içeren bir ödül modeli eğitecekler, bu şekilde kullanıcının gerçek niyetlerini yakalayacaklar. Aynı zamanda, ödül modelinin ödül etkisini en üst düzeye çıkarmak için pekiştirmeli öğrenme yoluyla bir strateji eğitilir. Başka bir deyişle, onlar Ne öğrenileceği (ödül modeli) ve nasıl yapılacağı (strateji) arasında bir ayrım yapılır.

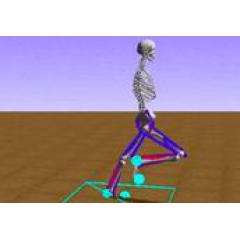

Ödül modelleme şeması: Ödül modeli, kullanıcı niyetini daha iyi yakalamak için kullanıcı geri bildirimlerine göre eğitilir; aynı zamanda ödül modeli, pekiştirme öğrenimi konusunda eğitimli aracılar için ödüller sağlar.

DeepMind geçmişte temsilciye kullanıcı tercihlerine göre ters çevirme yapmayı öğretmek, nesneleri hedef örneklere göre belirli şekillere yerleştirmek ve kullanıcı tercihlerine ve profesyonel gösterilere göre Atari oyunları oynamak gibi bazı benzer görevler yapmıştır (benim yorumumu yaparsınız). Gelecekte, DeepMind araştırmacıları, sistemin, kullanıcı geri bildirimine dayalı kullanıcı davranış modellerine adapte olmak için kendisini hızlı bir şekilde ayarlamasına izin verecek bir dizi algoritma geliştirmeyi umuyor. (Örn. Doğal dille)

Ödül modelinin ölçeğini genişletin

Uzun vadede, DeepMind araştırmacıları ödül modelinin ölçeğini şu anda insan değerlendirme yetenekleri için daha karmaşık olan bazı alanlara genişletmeyi umuyor. Bunu yapmak için, kullanıcıların sonuçları değerlendirme becerilerini geliştirmeleri gerekir. Bu nedenle, nasıl olduğunu da açıklayacaklar Özyineleme Ödül modelinin yerel uygulaması: Temsilciyi ödül modeli aracılığıyla eğitin, böylece kullanıcının değerlendirme sürecinde yardım sağlayabilir. Değerlendirme davranıştan daha basit hale geldiğinde, bu, sistemin basit görevlerden daha yaygın ve karmaşık görevlere geçebileceği anlamına gelir. Bu aynı zamanda yinelenen amplifikasyonun bir örneği olarak da görülebilir (ayrıntılar için bkz. "Süper AI" Tohumu? İnsanların değerlendirmesi zor olan o kadar karmaşık bir problem, bir AI öğretilebilir).

Yinelemeli ödül modelinin şematik diyagramı: Yinelemeli ödül modeliyle eğitilen aracı (sağdaki küçük daire), kullanıcıların eğitilen temsilci tarafından üretilen sonuçları değerlendirmesine yardımcı olur (sağdaki daire)

Örneğin, bir aracı eğiterek bir bilgisayar yongası tasarlamak istiyorsak, önerilen yonga tasarımının uygulanabilirliğini değerlendirmek için, yonga simülasyonu performans karşılaştırma testi ve hesaplamasını tamamlamamıza yardımcı olmak için bir ödül modeli aracılığıyla bir grup aracı "asistan" ı eğiteceğiz. Isı yayma performansı, çipin kullanım ömrü ve güvenlik açıklarının keşfi gibi görevler. Aracının "asistanının" çıktısı, kullanıcının çip tasarımının fizibilitesini değerlendirmesine yardımcı olur ve daha sonra kullanıcı, çip tasarım aracısını buna göre eğitebilir. Aracı "asistan" ın çözmesi gereken görevler dizisi bugünün öğrenme sistemi için hala biraz zor olsa da, doğrudan bir bilgisayar çipi tasarlamasına izin vermekten daha kolaydır: bir bilgisayar çipi tasarlamak için tasarım sürecini anlamalısınız Her değerlendirme görevi, ancak tersi değil. Bu perspektiften, yinelemeli ödül modeli, aracıya "destek" sağlamamıza olanak tanır, böylece kullanıcının niyetleriyle tutarlı olurken giderek zorlaşan görevleri çözebilir.

Araştırma zorlukları

Ödül modelini karmaşık sorunlara uygulamak istiyorsak, üstesinden gelmemizi bekleyen birkaç zorluk var. Aşağıdaki şekil, araştırmada karşılaşılabilecek 5 zorluğu göstermektedir.İlgilenen öğrenciler, bu zorlukları ve ilgili çözümleri ayrıntılı olarak açıklayan DeepMind belgesine başvurabilirler.

Ödül modellemeyi (solda) ve en umut verici çözümleri (sağda) genişlettiğimizde karşılaşacağımız zorluklar

Bu bize ajan hizalama probleminin son anahtar unsurunu hatırlatır: ajanlar gerçek dünyada kullanılmaya başlandığında, öncelikle bu ajanların tamamen uyumlu olduğunu kullanıcıya kanıtlamamız gerekir. DeepMind bu amaçla, kullanıcıların daha iyi hale gelmesine yardımcı olmak için makalede 5 öğe önerir. Güven Araştırma yaklaşımları şunlardır: tasarım seçimi, test etme, yorumlanabilirlik, resmi doğrulama ve teorik güvence. Ayrıca, ürün için yapacak iddialı bir fikirleri var. Güvenlik sertifikası , Sertifika esas olarak, geliştirilen teknolojinin güvenilirliğini kanıtlamak ve kullanıcının eğitim aracısını iş için kullanma güvenini artırmak için kullanılır.

Gelecekteki araştırma talimatları

DeepMind araştırmacıları, yinelemeli ödül modelinin ajan hizalama eğitimi için çok umut verici bir araştırma yönü olacağına ikna olsalar da, şu anda bu yönün gelecekte nasıl gelişeceğini tahmin edemiyorlar (daha fazla araştırmaya ihtiyacınız var!). Bununla birlikte, ajan hizalama sorununa odaklanan diğer birkaç araştırma yönünün de diğer araştırmacılar tarafından üretildiğini kutlamakta fayda var:

-

Taklit öğrenme

-

Miyop takviye öğrenme (

-

Ters takviye öğrenimi (

-

İşbirlikli ters pekiştirmeli öğrenme (https://arxiv.org/abs/1606.03137)

-

Yinelemeli genişleme (insanların değerlendirmesinin zor olduğu karmaşık bir problem, bir AI öğretilebilir)

-

Tartışarak öğrenme (insanlar kavga eder ve sinirlenir, ancak AI ve AI tartışması güvenliği sağlayabilir)

-

Acente vakıfları (Acente vakıfları) (https://intelligence.org/files/TechnicalAgenda.pdf)

DeepMind ayrıca makalede bu araştırma yönlerinin benzerliklerini ve farklılıklarını tartıştı.

Tıpkı rakip girdiler için bilgisayarlı görme sistemlerinin sağlamlığı üzerine yapılan araştırmanın bugün makine öğreniminin pratik uygulaması için hayati önemi olduğu gibi, aracı hizalama araştırmasının da karmaşık gerçek dünyada makine öğrenimi sistemlerinin konuşlandırılmasında anahtar olması bekleniyor. Kısacası, insanlığın iyimser olmak için bir nedeni var: Akademik araştırma, ödül modelini genişletmeye çalışırken zorluklarla karşılaşacak olsa da, bu zorluklar çözülmesi beklenen bazı özel teknik problemlerdir. Bu anlamda, bu araştırma yönü, derin pekiştirmeli öğrenme aracıları üzerine deneysel araştırmalar için hazırdır.

İlerleme sağlamak için konuyla ilgili araştırmaya yardımcı olmak, DeepMind'ın günlük çalışmalarında çok önemli bir konudur. DeepMind'ın araştırmasına katılmak isteyen bir araştırmacı, mühendis veya yetenekli bir uzmansanız, DeepMind ayrıca araştırma ekibine katılmak için başvuruda bulunmalarını da memnuniyetle karşılar.

DeepMind Safety Research aracılığıyla, Lei Feng.com AI Technology Review Compilation

-

- Yaramaz film günü patlaması | "Dumbo" Disney'in son yıllardaki "en kötü" gişesi oldu ve "Bohemian Rhapsody" rekor kırdı

-

- 55.000 Swarovski kristali ile işlenmiş bu NIKE Air Max 97 çifti, "gümüş mermiyi" saniyeler içinde öldürür!

-

- Bu çocuğa teşekkür ederim! Li Yifeng, komisyonculuk şirketiyle sözleşmenin süresinin dolduğundan şüphelenerek duyguyla yazdı

-

- Yazılım gömülü reklamlar saldırıya uğradı, binlerce bilgisayara Steam oyun korsanlığı Truva atı ile yüklendi

-

- Lu Benwei ve UU kız kardeşi yemek sırasında hayvanlar tarafından soyuldu ve bu bir çete eylemi gibi görünüyordu

-

- "Do Your Best" Nihayet Geçiyor Lou Ye'nin "Rüzgardaki Yağmurdan Yapılmış Bir Bulut", planlandığı gibi 4 Nisan'da yayınlanacak

-

- DÜNYA 2017 sonbahar ve kış konferansının sahne arkasında beynine saldırın! Binlerce öğenin özel önizlemesi!