2020'de AI akademik topluluğunda ani bir tartışma: Derin öğrenme nedir?

Yazar | Xiaofan Yang Editör | Camel

Editörün notu: 2019'un sonunda ve 2020'nin başında, makine öğrenimi çemberindeki birçok aktif profesör ve araştırmacı ani bir tartışmaya katıldı: Derin öğrenme nedir?

Son on yılda yükselen derin öğrenme dalgasında, herkes uygulamalardaki derin öğrenmenin çeşitli özelliklerine çok aşinadır, ancak sonuçta, derin öğrenme teorisi henüz kurulmamıştır. Daha da önemlisi, herkes derin öğrenmenin sınırlamalarının farkındadır. Sınırlamalardan kurtulmak ve daha gelişmiş bir bilgeliğe ulaşmak istiyorsanız, kaçınılmaz olarak "hedefe ulaşmak için derin öğrenmeyi geliştirmeye devam edin" veya "ihtiyacımız var" hakkında düşünmeniz gerekecektir. Derin öğrenmenin ötesinde yeniden başlayın ", işte ayrıca giriş Şu Basit görünüyor, ancak herkes "Derin öğrenme nedir?" Sorusu üzerinde henüz bir fikir birliğine varmadı.

Son zamanlarda birçok bilim insanı bu tartışmaya katıldı ve AI Technology Review sizi çeşitli tarafların görüşlerini gözden geçirmeye götürecektir.

Keras by Franço dır-dir Chollet bunu söyledi

Franço, Keras'ın yazarı ve Google Brain'de kıdemli araştırmacı dır-dir Chollet önce fikrini verdi:

Derin öğrenme nedir? 2019'daki bu noktada, herkesin sıklıkla kullandığı derin öğrenmenin tanımı kabaca şu şekildedir: "Bir dizi farklılaştırılabilir parametreleştirilmiş katmandan oluşur ve geri yayılım algoritması kullanılarak uçtan uca eğitilir." Ama bu ifade bence çok dar, en iyi ihtimalle "Şu anda yaptığımız derin öğrenme" Derin öğrenmenin tanımı değil, derin öğrenmenin tanımı.

Örneğin, evrişimli bir ağ modeliniz varsa ve ardından ağırlıklarını eğitmek için ADMM kullanıyorsanız, bu derin öğrenme değil mi? Kendi özelliklerini öğrenen bir HMAX modeli derin öğrenme değil midir? Açgözlü bir algoritma ile katman katman eğitimli derin bir sinir ağı bile derin öğrenme değil mi? Söylemek istersem, hepsi derin öğreniyorlar.

Derin öğrenme, modelin bir dizi modülden (genellikle "derinliğin" kaynağı olan çok katmanlı veya piramit bir modele yığılmış) oluştuğu temsili bir öğrenme yöntemine atıfta bulunmalıdır. Her modül, ayrı ayrı eğitildikten sonra bağımsız bir özellik çıkarıcı olarak kullanılabilir. Bunu kendi kitabımda böyle tanımladım.

Bu tanımla, derin öğrenmenin aşağıdaki model olmadığını da netleştirebiliriz:

SIFT, sembolik AI gibi yapay özellik mühendisliği gibi temsilleri öğrenmeyen modeller.

Derin öğrenmenin tanımının sabit bir öğrenme mekanizması (örneğin geri yayılım) belirtmesi veya sabit kullanım yöntemi (denetimli öğrenme veya pekiştirmeli öğrenme gibi) belirtmesi gerekmez ve ortak uçtan uca öğrenme yapmak gerekli değildir. (Açgözlü öğrenmenin tersi). Bu, derin öğrenmenin "ne olduğu" nun temel niteliği ve temel yapısıdır. Bunun ötesinde tanım, sadece "derin öğrenmeyi nasıl yapıyoruz" dur.

Net bir tanım aynı zamanda net bir sınır çizer, bazı şeyler derin öğrenmedir, bazıları değildir. 2019'da her yerde görülebilen bu tür derin sinir ağı doğal olarak derin öğrenmedir ve evrimsel stratejiler ES, ADMM ve sanal gradyanlar gibi geri yayılma alternatifleriyle eğitilmiş derin sinir ağları elbette derin öğrenmedir.

Genetik programlama derin öğrenme değildir, hızlı sıralama derin öğrenme değildir, SVM de değildir. Tamamen bağlantılı tek bir katman derin öğrenme değildir, ancak çok sayıda tamamen bağlantılı katman bir araya getirilmiştir; K-anlamı algoritması derin öğrenme değildir, ancak yalnızca birçok K-aracı özellik çıkarıcıyı yığınlar. 2011 ve 2012 arasında bile, video verilerinin konumu hakkında ikili ortak bilgiler topladım matris Ve sonra koy matris Üst üste yığılmış ayrıştır Yukarıda , Aynı zamanda derin öğrenmedir.

Sıradan insan yazılım mühendisleri tarafından dilde yazılan programlar derin öğrenme değildir. Bu programları verin Artı Parametreler, birkaç sabiti otomatik olarak öğrenebilir, yine de derin öğrenme değildir. Derin öğrenme olan karakterizasyon öğrenimi için bir dizi özellik çıkarıcı kullanmak gereklidir. Özü, girdi verilerini derin hiyerarşik özellikler aracılığıyla tanımlamaktır ve bu özelliklerin tümü verilerden öğrenilir.

Tanım gereği de görülebilir, Derin öğrenme, aşamalı bir iyileştirme ve verilerden temsilleri çıkarmak için küçük bir optimizasyon yöntemidir. Mevcut derin öğrenme biçiminde, en az C1 süreklidir (sonsuz düzene kadar). Bu çok kritik olmayabilir, ancak "aşamalı optimizasyon" da derin öğrenmenin doğasında bulunan bir özelliktir.

Bu nedenle, derin öğrenme, önceki sembolik bilgi işlem yapay zekası ve geleneksel programlamadan tamamen farklıdır.Temel yapısı, çekirdek olarak veri akışı ile ayrıktır ve genellikle herhangi bir ara veri gösterimi gerektirmez.

Sembolik işlemler yapmak için derin öğrenmeyi kullanmak imkansız değildir, ancak çok fazla ekstra adım gerektirir. Ancak yine de derin öğrenme modelleri tüm programların sadece çok küçük bir kısmını kapsayabilir ve her şey için derin öğrenmeye gerek yoktur.

Bir soru daha genişletilebilir: Beyin "derin öğrenme" mi? Sadece şu yanıta katılıyorum: beyin hayal edilemeyecek kadar karmaşık bir şeydir, farklı yapılara sahip birçok şeyi içerir ve beyin hakkında hala çok az şey biliyoruz; beyin derin öğrenme mi, biz hala Kesin bir cevap veremiyorum. Beynin bir bütün olarak derin öğrenme olmadığına dair bir sezgim var, ancak bazı alt modülleri derin öğrenme ile tanımlanabilir veya bir kısmı derin öğrenme ile uyumludur.Örneğin, görsel korteks derin hiyerarşik özellik temsillerine sahiptir, bunlar bile Tüm temsiller öğrenilmez; görsel korteks ayrıca derin öğrenme araştırmalarında önemli bir ilham kaynağıdır.

Modern derin öğrenme anlayışımızı ve kullanımımızı karşılaştırmak için bir ağaç yapısı kullanırsak, bir cümle daha ekleyebilirim. ana Hala daha önce geliştirilen "modern makine öğrenimi" dalında kalıyor ve sinirbilimle çok az ilgisi var. Sinirbilimin etkisi ana İçinde yatıyor Yüksek seviye Doğrudan taklitten ziyade yeni fikirlerden ilham aldı.

Yann LeCun dedi

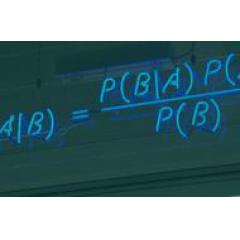

Başka bir hikayede, derin öğrenme troikalarından biri olan Yoshua Bengio ile "her zaman derin öğrenme hayranı" Gary Marcus arasındaki yıllık çekişme, klasik bir soru bıraktı: "Derin öğrenme yeterli mi?" (" Dır-dir DL yeterli mi? ") Bu aynı zamanda" derin öğrenme nedir? "Tartışmasına da yol açar. 2011 Turing Ödülü sahibi ve Bayesian Networks'ün babası Judea Pearl, "derin öğrenmenin net bir tanımı olmadığı için derin öğrenmenin yeterli olup olmadığına cevap veremiyorum" dedi.

Yann LeCun'dan geldiği söylenen bir tanım var: Derin öğrenme, bir model oluşturmak için birden çok parametreleştirilmiş modülü bir grafikte (dinamik grafik olabilir) birleştiren ve ardından gradyan tabanlı bir yöntemle optimize eden bir metodolojidir. LeCun, derin öğrenme bu şekilde tanımlanırsa, derin öğrenmenin şimdiye kadar karşılaşılan sorunları çözmek için yeterli olmaktan uzak olduğunu, çünkü bu tanım kapsamındaki model mimarisi, optimizasyon hedefleri ve optimizasyon yöntemlerinin belirli sınırlamaları olduğunu belirtti.

Tartışma sırasında, derin öğrenmenin tanımı tartışmalıysa, neden derin öğrenmenin olmadığını listelemeyelim? LeCun tarafından verilen cevap şudur: lojistik regresyon, çekirdek yöntemi, naif Bayes, ağaç ormanı, K-ortalamalar, K-NN derin öğrenme değildir, çünkü veri temsilini öğrenmezler; Ayrıca 0-sıralı yöntemle (gradyan olmayan ) Optimize edilmiş oldukça farklılaştırılamayan modeller, veri temsilini öğrenebilseler bile derin öğrenme değildir.

Bir veya iki gün süren tartışmalardan sonra, bilim adamları hemen geniş bir fikir birliği oluşturamadılar. Judea Pearl biraz hayal kırıklığına uğradı ve bu özeti kendisi yaptı:

İyi bir tanım görememiş olsam da, "derin öğrenme nedir" tartışmasındaki hislerim, derin öğrenme yapanların derin öğrenmenin sınırsız potansiyele sahip olduğuna inandığı ve bu programlardan sarhoş olduğu yönündedir. , Beceriler ve terminoloji. İkinci ve üçüncü haftalara kadar lisede nasıl cebir okuduğumu hatırladım ve bu yöntemlerin sınırsız problem çözme yeteneklerine sahip olduğuna da inanıyoruz. Fakat öğretmen bize, iki denklemde üç bilinmeyen varsa bu denklemi çözemeyeceğinizi söyledi; bu cümleyi duyduğumuzda kaçınılmaz olarak hayal kırıklığına uğrayacağız ve kendi cehaletimizi hissedeceğiz, ama aynı zamanda Çözümü olmayan denklemlere çok fazla zaman kaybetmekten kaçınırız. Mesele şu ki dostlarım, artık herkes lise öğrencisi değil.

LeCun, tartışmaya aşağıda devam etti:

Yani tanımımı kabul etmiyorsun? Benim tanımıma göre, derin öğrenme, birden çok parametreleştirilmiş modülü bir grafikte birleştiren (dinamik bir grafik olabilir), bir model oluşturan, bir amaç işlevi belirleyen ve daha sonra bunu gradyan tabanlı bir yöntemle optimize eden bir metodoloji. "Derin" olacaksa, grafiğin girdiden çıktıya akışta birçok doğrusal olmayan aşamaya sahip olması gerekir; bu derinlik aynı zamanda modelin iç gösterimleri öğrenmesine de izin verir. Tanımım belirli bir öğrenme paradigmasını (denetimli, denetimsiz ve pekiştirmeli öğrenme) belirtmiyor ve hatta yapı ve hedefler bile sabit değil.

Judea Pearl bu tartışmaya katılmaya devam etmedi, ancak Franço ile karşılaştırıldığında dır-dir Chollet ve Yann LeCun tarafından verilen cevapların, fikirlerinin çoğunun aynı olduğunu görmek zor değil, ancak LeCun gradyan tabanlı optimizasyon yöntemlerinin de derin öğrenmenin bir parçası olduğuna inanıyor, Chollet ise gradyan tabanlı yöntemlerin de kullanılabileceğine inanıyor-Chollet tanımı Altında derin öğrenme daha geniştir.

Sonra öne geri Şu Soru, Cholletin daha geniş derin öğrenme tanımı kabul edilse bile, derin öğrenme yeterli mi? Onun tutumuna göre yeterli değil; o kadar çok yöntemimiz var ki, derin öğrenmeye bağlı kalmaya gerek yok. Bugün kullanılabilecek sadece derin öğrenme sorunu olsa bile, derin öğrenmeye dayalı bir çözüm kullanmak her zaman gerekli değildir.

Eski modele derin öğrenme perspektifinden bakın

Ancak günümüz derin öğrenme perspektifinden bakıldığında, bazı klasik yöntemler ilginç hale gelmiş gibi görünüyor. Derin öğrenme araştırmacısı ve Fast.ai kurucusu Jeremy Howard, derin öğrenmenin sınırları tartışmasına da katılarak, lojistik regresyonun artık derin öğrenmeye benzediğini, veri örneklerinde kullanılabilen derin, parametreli bir fonksiyon modülü olduğunu söyledi. Eğitmek için gradyan tabanlı yöntemi kullanın. Hatta, kendi duygularına göre, Menteşe Kaybı kaybı işlevi ve L1 düzenli sinir ağının bir işlevi olarak SVM ile öğrenmek ve öğretmek çok daha kolaydır.

LeCun ayrıca şunları kabul etti: "Bir SVM, ilk katmandaki her nöronun girdiyi bir çekirdek işlevi aracılığıyla belirli bir eğitim örneğiyle karşılaştırdığı iki katmanlı bir sinir ağıdır (bu nedenle, aslında ilk katman, denetimsiz öğrenmenin önemsiz bir biçimidir: Bellek) ve ardından ikinci katman bu çıktıların doğrusal kombinasyonunu hesaplayacaktır (eğitimden sonra). "

Tartışmaya katılan pek çok netizen, bu anlayış karşısında şok olduklarını ifade etti ve bir tanesi, "Bir iş görüşmesi sırasında, SVM'yi uygulamamı ve ardından onu eğitmek için gradyan inişini kullanmamı istediler. Lanet Bu sadece bir Menteşe Kaybı sinir ağı değil mi? İlk başta büyük bir mesele değildi, ama daha sonra bunun gerçekten harika olduğunu anladım. "

Bazı netizenler şunu sordu: "Sadece iki katmanınız olamaz mı? Bir çekirdek işlevini öğrenmek için birçok katmanı kullanabilir ve ardından çekirdek yönteminin tahmin kurallarını hesaplamak için son katmanı kullanabilirsiniz. Çekirdeğin bir Mercer çekirdeği olduğundan emin olmak için bazı kuralları uyguladığınız sürece, ağ Çekirdek görevi gören katmanların sayısı sınırsız olabilir. " LeCun cevapladı: "Çekirdek işlevi rastgele karmaşık olabilir. Ancak çekirdek işlevi öğrenilirse, bu zaten derin öğrenmedir ... Aslında, metrik öğrenme olan Siyam ağını eğitirken yaptığımız şey budur. . Bu, benzerlik çekirdeğini eğitmek gibidir. Son olarak, isterseniz, şunu da yapabilirsiniz: Yukarıda Başka bir doğrusal katman ekleyin. "

Yeni on yıllık derin öğrenme için nimetler

Makalenin sonunda, Li Feifei Gaotuo ve Tesla AI şefi Andrej Karpathy'nin bir tweetinden alıntı yapmak istiyorum.

Bugün, bazı netizenler Reddit'e "Sınıflandırma görevleri için sinir ağları dışındaki yöntemleri kullanmak teorik olarak mümkün mü?" Diye soracaklar. Ama aslında, yaklaşık sekiz yıl önce, görmeniz daha muhtemel olan soru "Kullanmak istiyorum Sinir ağı yöntemlerinin alt hedef tanıma gerçekleştirmesi teorik olarak mümkün müdür? "Son birkaç yılda yaşanan değişiklikler gerçekten ilginç.

Daha eksiksiz teoriler, daha zengin uygulamalar ve kaynakların daha verimli kullanımıyla derin öğrenmenin gelişmeye devam ettiğini görmekten mutluyuz. Aynı zamanda, daha fazla araştırmacı ve geliştiricinin, derin öğrenmenin Şu Tek ve nihai çözüm. Bu yeni on yılda 2020'de derin öğrenmenin eksikliklerini tamamlamak için daha gelişmiş yeni yöntemler görmeyi dört gözle bekliyoruz.

AI teknolojisi inceleme raporu.

-

- Today Paper | Sivrisinek çağrısı veri seti; konuşma tanımanın doğruluğunu artırın; ikili dikkat öneri sistemi vb.

-

- AAAI 2020 | Bilgisayar Teknolojisi Enstitüsü'nden Feng Yang Grubu: Makine çevirisinin akıcılığını ve doğruluğunu iyileştirmek için değerlendirme modüllerini tanıtın (açık kaynaklı)