Neden boyutsal bir felaket var? Nasıl çözülür?

Makine öğrenimi alanındaki insanlara tavsiye vermek istiyorsanız, bu: boyutsallık felaketini asla unutmayın. Geleneksel açıklama şudur: "Çok fazla girdi boyutunuz varsa, o zaman problem pahalı ve çözülmesi zor hale gelir." Bu doğru, ama neden böyle? Bu konuyu daha detaylı tartışalım.

Boyutsal felaket için en sezgisel açıklamalardan biri, birim hiperküre ve hacmine bakmaktır. Bu ne anlama geliyor? Veri noktaları esas olarak d boyutlu vektörler olarak ifade edilir. Belirli bir problemdeki tüm veri noktalarının birim hiper kürede bulunduğunu varsayıyoruz. Hiperferin hacmini 3B olarak hepimiz biliyoruz, bu:

Bunu d boyutlarına genişletmek için, hacim denklemindeki sabitleri göz ardı edip c değişkenine koyabiliriz, ardından hacim denklemi aşağıdaki biçimi alır:

Aşağıdaki daireye geometrik olarak bakıldığında, noktaların çoğu kabukların arasına düşüyor (mavi ve kırmızı çizgiler arasındaki boşluk). Başka bir deyişle, 0.95 yarıçaplı bir birim çemberin kabuğu da çemberin alanının sadece küçük bir bölümünü kaplar:

Rastgele veri noktalarının oluşturulduğu bir birim çember

Şimdi, d-boyutlu bir hiperküre gözlemlediğimizde ne olduğunu hayal edin? Çoğu insan bunun aynı durum olduğunu söyler, hacmin çoğu hiper kürenin dış kabuğunu aşar. Ama çoğu insan yanılıyor. Gerçek şu ki, insanlar yüksek boyutlu uzay hakkında gerçekten düşünemezler. Sezgisel değil, hayal edemiyoruz. Gerçekte ne olduğuna bir bakalım. Kabuğun d-boyutlu hiperferden işgal ettiği hacim oranını şu şekilde yazabiliriz:

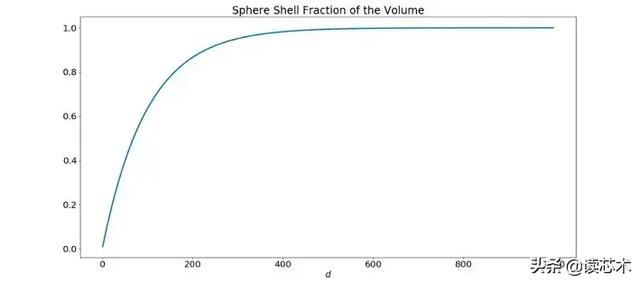

Kabuğun hiper küresinin yarıçapının% 5'ini alırsak puanın nasıl değişeceğini gözlemleyin Şimdi sorun çok açık. Giriş boyutu d arttıkça, aşağıdaki şekilde gösterildiği gibi, kabukta bulunan hacimlerin sayısı önemli ölçüde artar:

Bu şekil, kabuğun hipersferde işgal ettiği hacim fraksiyonunun, verilerin boyutluluğu arttıkça arttığını göstermektedir.

Kabuğun hacim oranının üssel olarak arttığını ve 1,1'e doğru olan boyutun sınırı olduğunu görebiliriz. Küçük bir miktar r için bile, kabuğun fraksiyonu hızla 1'e çıkar.

Bu ne anlama geliyor ve böyle bir sorun ne zaman ortaya çıkacak? Bu değişikliği gözlemlemek için makine öğreniminde en sık kullanılan dağıtım olan Gauss dağılımına bir göz atalım. Üç boyutlu girdi uzayının Gauss yoğunluğunu gözlemlersek, yarıçapın ortalama değeriyle olasılığın azaldığı bir hiperküre gibidir. Bu genellikle 3 boyuttan fazlası için geçerlidir. Aşağıdaki şekilden anlayabilirsiniz:

İki boyutlu Gauss dağılımının Gauss yoğunluğu. Yoğunluğun elips benzeri bir nesneye nasıl yansıtıldığına dikkat edin, daha yüksek boyutlu alanlarda benzer davranışlar beklenebilir.

Yüksek boyutlu uzayda, Gauss yoğunluğu hiperferinin kabuğunda yoğunlaşır Bunun nedeni, hiperferin hacminin, yüksek boyutlu uzayda önemli hale gelen kabuğun bir parçası olmasıdır. Bu, Gauss örneklemesi durumunda, sonucun hiper kürenin dış kabuğundan en yüksek olasılığa sahip veri noktası olacağı anlamına gelir.

Boyutsal felaketleri ampirik riski en aza indirme perspektifinden düşünebiliriz. Kısaca, verilerimizden temsili eğitim örnekleri almayı umuyoruz, böylece görünmez verileri genelleştirebiliriz. Şimdi, hiper küre örneğinde, kürenin küre yarıçapı kalınlığı% 5 olduğunda, veri boyutunun yaklaşık 400 boyut olduğunu ve kürenin dış kabuğunun hacmin% 90'ından fazlasını içereceğini kontrol ettik. Kürenin merkezi (% 0 yarıçap) ve% 95 yarıçap arasında veri örneklerimiz olduğunu hayal edin. Bu durumda, yarıçapın% 95'ini kapladık, ancak hacmin yalnızca% 10'undan daha azını kapladık. Açıkçası, bu durumda temsili bir numune elde etmek zordur.

Neyse ki boyutluluk laneti, etkili modeller inşa edemeyeceğimiz anlamına gelmez. Genellikle veriler için bazı pürüzsüzlük garantilerimiz vardır ve veri alanı boyut olarak çok yoğun bir şekilde doldurulamaz veya küçültülemez (makine öğrenimi araştırmasının büyük bir kısmı). Belki de en iyi örnek, tüm olası 64x64 RGB görüntülerin alanıdır. Verilerin boyutu 64x64x3 = 12288'dir. Bir hiperfer örneğini ele alırsak, bu açıkça bir problemdir. Ancak aslında, çeşitli piksel kombinasyonlarının çoğu, herhangi bir sınıflandırma türü için anlamsızdır. Ek olarak, bilgisayarla görme yöntemlerinin, sorunun çözülmesini kolaylaştıran birçok yararlı ön kararı vardır.

-

- 70 yıl önce bugün, Halk Kurtuluş Ordusu, Peiping'i şehre girmek için bir tören düzenledi ve bu değerli eski fotoğrafları bıraktı!

-

- Zhejiang, dünya çapında bir şehir kümesi oluşturmak için Yangtze Nehri Deltası'nın entegre gelişimini şiddetle teşvik ediyor

-

- JD Express kişisel hizmeti, tıpkı SF Express gibi çevrimiçidir ve bir tazminat kaybetmenin maliyeti daha düşüktür

-

- Mobil, 100 milyon geniş bantın ücretsiz olduğunu söyledi, ancak bu rutini benimle oynamayı beklemiyordum