Makine öğrenmiyor: derin öğrenmeye dayalı video etiketi çıkarma algoritması

İçerik çağının gelişiyle birlikte, multimedya bilgilerinin, özellikle görüntü sınıflandırma, görüntü etiketleme, video işleme gibi video bilgilerinin analizi ve anlaşılması giderek daha acil hale geldi. Şu anda, görüntü sınıflandırması uzun yıllardır geliştirilmiş ve belirli koşullar altında iyi sonuçlar elde edilmiştir. Bu makale esas olarak gerçek ürün gereksinimleri nedeniyle video etiketleme sorununu ele almaktadır.

Yazar, bazı materyallere danıştıktan sonra, metin, resim veya video olsun, etiketleme sorununun, şu anda iyi çözülmemiş olan içeriğin çok fazla "anlaşılmasını" içerdiği konusunda mütevazı bir görüşe sahip. Ana nedenler aşağıdaki hususlardır: Etiketler, arka plan içerik etiketleri, ayrıntılı içerik etiketleri, içerik öznitelik etiketleri, stil etiketleri vb. Dahil olmak üzere çeşitlidir; bazı etiket örneklerinin gerçek performansı çeşitlidir ve örneklerin düzenliliği açık değildir. Model öğrenimi: Etiketleme problemine tek bir standart cevap yoktur ve ayrıca belirli bir derecede öznellik vardır Değerlendirmesi kolay olmayan problemler model öğrenmeye daha da zararlıdır.

Benim mütevazı görüşüme göre, video etiketleme sorununun hala iyi bir çözümü yok ve bu hala keşif aşamasında. Yöntemin esas olarak şu fikirleri vardır: Video perspektifinden başlayabilir, görüntü perspektifinden başlayabilirsiniz; altyazının ürettiği fikirleri, çoklu sınıflandırma problemine dönüştürülebilir kullanabilirsiniz.

Doğrudan video bakış açısından, yani videonun genel bakış açısından, görüntü karelerini, hatta altyazıları veya ses bilgilerini çıkarın ve video etiketinin sonucunu daha da işleyin. Derin Öğrenme YouTube Video Etiketleri, bu makale, etiket korelasyonunu ve etiketlerin bağımlılığını dikkate almak için videonun görüntü özelliklerini ve LSTM modelini kullanan kelime yerleştirmelerini birleştiren karma bir CNN-RNN yapısı önermektedir.Ağ yapısı aşağıda gösterildiği gibidir.

Evrişimli Sinir Ağları ile Büyük Ölçekli Video Sınıflandırma, ağdaki zamansal ve uzamsal bilgileri yansıtmak için video sınıflandırmasına uygulanan çeşitli evrişimli sinir ağı yapılarını önerir. Tek kare: Görüntüyü işleyen sıradan CNN'den farklı olmayan bir görüntü karesini CNN'ye ayrı ayrı girmektir; geç füsyon: İki görüntü karesini birlikte L sırasıyla iki CNN'ye ve sonra sonuncusuna girin Katman, aynı tam bağlantının softmax katmanına bağlanır; erken füzyon: ardışık L çerçevelerinin görüntüleri bir araya yığılır ve bir CNN'ye girilir;

Yavaş füzyon: Zaman ve uzay boyutlarına evrişimli katmanlar ekleyerek, daha fazla mekansal-zamansal küresel bilgi sağlar. Aşağıda gösterildiği gibi:

Öte yandan, eğitim hızını artırmak için bu makale, aşağıdaki şekilde gösterildiği gibi, orta kısmın görüntüsünü ve yakınlaştırılmış görüntüyü ağın girişi olarak alan Çoklu Çözünürlüklü CNN'leri de önermektedir:

Bu makale esas olarak evrişimli sinir ağlarının büyük ölçekli video sınıflandırmasında uygulanmasını ve performansını incelemektedir. Deneyler aracılığıyla makale, ağ ayrıntılarının evrişimli sinir ağlarının etkisine çok duyarlı olmadığı sonucuna varıyor. Ancak genel olarak, yavaş füzyon ağ yapısı daha iyi çalışır.

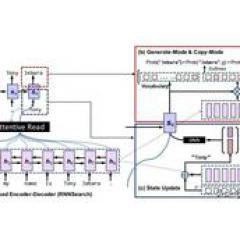

Görüntü açısından bakıldığında, videodan bazı kareler çıkarın ve kare görüntünün analizi yoluyla video etiketinin sonucunu daha da elde edin. Görüntülerin analizi, görüntü etiketleme veya görüntü tanımlama problemlerine de dönüştürülebilir. Görsel-Metin: Çerçeve Açıklamalarını kullanarak Video Etiketleme, önce videodan sabit sayıda kare çıkarın ve eğitimli görüntüyü alt yazı modeline görüntünün bir açıklamasını oluşturmak için kullanın. Ardından metin açıklamalarını birleştirin, metin özelliklerini çıkarın ve sınıflandırmak için sınıflandırma yöntemini kullanın ve etiket sonucunu alın. Bu makale, birçok farklı özelliği ve birçok farklı sınıflandırma yöntemini oluşturulan açıklamayla karşılaştırır. Görüntü etiketlemenin video etiketleme için büyük bir referans önemine sahip olduğu görülebilir. Başka bir düşünce biçimi, CNN-RNN: Çok Etiketli Görüntü Sınıflandırma için Birleşik Çerçeve, görüntü etiketleme sorununu çoklu sınıflandırma sorununa dönüştürmek olarak görülebilir. Evrişimli sinir ağlarını çok etiketli sınıflandırma problemlerine uygulamanın yaygın bir yöntemi, bunları birden çok tek etiketli sınıflandırma problemine dönüştürmek ve eğitim için sıralama kaybı veya çapraz entropi kaybı kullanmaktır. Ancak bu yöntem genellikle etiketler arasındaki bağlantı sorununu veya etiketler arasında anlamsal çoğaltma sorununu göz ardı eder. Bu makale CNN-RNN'nin ağ yapısını tasarlar ve etiketler arasındaki korelasyonu, etiketler arasındaki fazlalık bilgileri ve görüntülerdeki nesne ayrıntılarını daha iyi yansıtmak için dikkat mekanizmasını kullanır. Ağ yapısı, esas olarak iki bölümden oluşan aşağıdaki şekilde gösterilmektedir: CNN bölümü görüntünün anlamsal ifadesini çıkarır ve RNN bölümü esas olarak görüntü ile etiket arasındaki ilişkiyi ve etiketler arasındaki bağımlılık bilgisini elde eder.

Mekandaki kısa video verileri için yazar basit bir video etiketleme şeması tasarladı ve deneyler yaptı. Ön işleme ve algoritma ayrıntılarında daha fazla iyileştirme ve iyileştirme henüz yapılmadığından, burada sadece bir düşünme şekli ve deneysel sonuçların basit bir paylaşımı var.

Yöntem tanıtımı:

Genel fikir: resim etiketleme = > Video etiketleme

Yani videodaki resimleri elde etmek için videodan kareleri çıkarın; ardından resimleri etiketleyin; son olarak, video etiketlerini elde etmek için videodaki çerçeve resimlerinin etiketlerini entegre edin.

1. Resim açıklamasından konuşma:

Resim açıklaması tipik çerçeve: Giriş görüntüsünü kodlamak için derin evrişimli sinir ağını kullanın ve ardından çıktı metin açıklaması oluşturmak için Uzun Kısa Süreli Bellek (LSTM) RNN kod çözücüyü kullanın.

2. Etiketleme görevinde, etiketleri veya kategorileri bir "açıklama" olarak birleştiririz:

Birincil kategori + ikincil kategori + etiket (tekrarlanan kelimeler kaldırılır)

3. Örnek görüntüleri ve etiketleri eğitmek için model eşlemeleri oluşturmak için ön eğitim ve pekiştirmeli öğrenmeyi kullanın.

"Görüntü Altyazıları için Öz Kritik Sıra Eğitimi"

Üç ağ modeli vardır: fc modeli; yukarıdan aşağıya modeli; att2in modeli; modelin ayrıntıları için kağıda bakın.

Genel olarak, girdi görüntüsü ve çıktı metni hedefi göz önüne alındığında, model eğitimi süreci, çapraz entropi kaybını en aza indirmektir (maksimum olabilirlik eğitimi hedefi):

Kendi kendini eleştiren politika gradyan eğitim algoritmasını kullanma:

Bunların arasında ödül işlevi var

Açgözlü bir arama olan her bir kod çözme zaman adımının olasılık dağılım çıktısının maksimize edilmesiyle elde edilen temel çıktı olan her bir kod çözme zaman adımının olasılık dağılımına göre örneklenerek elde edilir. Makalede ödül işlevi olarak CIDEr metriğini kullanmanın en iyisi olduğu belirtiliyor.

4. Videoyu, video çerçeve resminin etiketine göre etiketleyin. İki spesifik fikir var:

Çıkarılan videonun tüm karelerinde görünen etiketi ve etiketin kaç kez göründüğünü (orada kaç kare vardır)

Bu etiketle etiketlendi). Oluşum sayısına göre sıralayın.

1. Çerçeve resminin üst n etiketini video etiketleri olarak çıkarın.

2. Çerçeve resminde, oluşum süreleri eşik c'den daha büyük olan etiketler video etiketleri olarak çıkarılır.

Veri örneği:

Bunlar arasında, 1 sınıf birinci sınıf, 2 sınıf ikinci sınıf anlamına gelir.

Deneysel sonuçlara örnekler:

Bazı deneysel sonuçlar yakalanır ve aşağıda gösterilmiştir; burada çıktı, model çıktısının sonucunu ve referans, manuel kalibrasyonun referans sonucunu ifade eder.

Genel olarak oyun videoları en büyük miktarda veriye sahiptir ve daha iyi sonuçlara sahiptir; ancak farklı kahramanların video verileri dengesiz ise algoritma sonuçlarını da etkileyecektir. Diğer video veri türlerinin etkisi çok seyrek değildir, ancak uzun kuyruklu videonun etkisi iyi değildir.

sonuç olarak:

Veri ön işleme, model yapısı, kayıp işlevi, optimizasyon yöntemi ve diğer hususlar, video etiketleme uygulamasının gerçek durumuna göre ayarlamaya değer birçok yer vardır. Takipte optimizasyona devam edin. Yöntemler ve deneyler hala kaba, umarım sizi eleştirir ve yol gösterirsiniz.

Orijinal metin WeChat Resmi Hesabı-Tencent QQ Büyük Veri (qq_bigdata) üzerinde yayınlandı

-

- Premier Lig toplantısı: Alman çift halkalı Hornetler zafer kazanıyor, iblis cephesi bir başlık takıyor ve azizi ele geçiriyor

-

- Ruby Ruby tatil fotoğrafları çekti, ancak Huo Jianhua'yı görmedi. Lavaboda otururken öfkeyle övüldü: iyi ayakkabılara sahip bir kız

-

- Tsinghua Üniversitesi yayınlandı: Yüz tanıma ile ilgili en eksiksiz veri raporlarından oluşan bir koleksiyon, paylaşın

-

- Wuhan'daki bu robot şirketi CCTV'ye gitti ve "Kuşak ve Yol" pazarına girmek için köklü bir İtalyan şirketini satın aldı

-

- Li Zixuan'ın tulum ve netizenler ile sonbahar kıyafetleri giydiğini görene kadar çok zayıf olduğunu düşünmüştüm: sırtı gerçekten güçlü