Google yetkilisi: geri yayılım algoritmasının gösterimi

Xinzhiyuan önerilir

Kaynak: google-developers.appspot.com

Xin Zhiyuan Rehberi Geri yayılım algoritması (BP algoritması) şu anda yapay sinir ağlarını eğitmek için en yaygın kullanılan ve en etkili algoritmadır. Google'ın makine öğrenimi hızlandırılmış kursu için destekleyici bir materyal olarak Google, geri yayılım algoritmasının çalışma prensibini sezgisel olarak tanıtan bir demo web sitesi başlattı.

İnternet adresi:

https://google-developers.appspot.com/machine-learning/crash-course/backprop-scroll/

Geri yayılım algoritmaları, büyük sinir ağlarının hızlı eğitimi için gereklidir. Bu makale, algoritmanın çalışma prensibini tanıtacaktır.

Basit sinir ağı

Yukarıdaki şekilde gösterildiği gibi, bir giriş düğümü, bir çıkış düğümü ve iki gizli katman (her biri iki düğüm) içeren bir sinir ağı göreceksiniz.

Bitişik katmanlardaki düğümler ağırlıkları geçer

Aktivasyon fonksiyonu

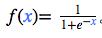

Her düğümün toplam girişi x, aktivasyon işlevi f (x) ve çıkışı y = f (x) vardır.

f (x) doğrusal olmayan bir fonksiyon olmalıdır, aksi takdirde sinir ağı yalnızca doğrusal modelleri öğrenebilir.

Yaygın olarak kullanılan etkinleştirme işlevi sigmoid işlevidir:

Hata fonksiyonu

Amaç, verilere dayalı olarak ağın ağırlıklarını otomatik olarak öğrenmektir, böylece tüm girdiler

Bu hedefle olan boşluğu ölçmek için bir hata fonksiyonu kullanıyoruz

İleri yayılma

İlk önce bir girdi örneği alıyoruz

Tutarlılığı korumak için, girdiyi diğer herhangi bir düğümle aynı gibi, ancak bir etkinleştirme işlevi olmadan, böylece çıktısının girdiye eşit olmasını sağlarız.

Şimdi ilk gizli katmanı güncelliyoruz. Önceki düğüm katmanının y çıktısını alıyoruz ve ağırlıkları bir sonraki düğüm katmanının x girdisini hesaplamak için kullanıyoruz.

Ardından, ilk gizli katmandaki düğümün çıktısını güncelliyoruz. Bunun için f (x) aktivasyon fonksiyonunu kullanıyoruz.

Bu iki formülü kullanarak ağın geri kalanına yayılabilir ve ağın son çıktısını elde edebiliriz.

Hata türevi

Geri yayılım algoritması, belirli bir numunenin tahmin edilen çıktısını ideal çıktıyla karşılaştırır ve ardından ağın her ağırlığının güncelleme aralığını belirler. Bunun için her ağırlığa göre hatayı hesaplamamız gerekiyor.

Hata türevini aldıktan sonra, ağırlıkları güncellemek için basit bir güncelleme kuralı kullanabiliriz:

onların arasında,

Güncelleme kuralı çok basittir: ağırlık artırıldıktan sonra hata azalırsa (

Diğer türevler

Hesaplamaya yardımcı olmak için

Geri yayılım

Hata türevini geri yaymaya başladık. Bu belirli girdi örneği için tahmin edilen çıktıya sahip olduğumuzdan, bu çıktıyla hatanın nasıl değiştiğini hesaplayabiliriz. Hata fonksiyonumuza göre

Şimdi anlıyoruz

Bunlar arasında, f (x) S tipi aktivasyon işlevi olduğunda,

Bir düğümün toplam girdisine göre hata türevi elde edildiğinde, o düğüme giren ağırlığa göre hata türevini elde edebiliriz.

Zincir kuralına göre bir önceki katmandan da alabiliriz

Ardından, tüm hata türevleri hesaplanana kadar önceki 3 formülü tekrarlayın.

Son.

Topluluğa katıl

Xinzhiyuan AI teknolojisi + endüstri topluluğunun işe alımında, AI teknolojisi + endüstrisiyle ilgilenen öğrenciler küçük bir WeChat asistanı hesabı ekleyebilirler: aiera2015_3 Gruba katılın; incelemeyi geçtikten sonra sizi gruba katılmaya davet edeceğiz. Topluluğa katıldıktan sonra, grup açıklamalarını değiştirmelisiniz (isim-şirket-pozisyon; profesyonel grup incelemesi katıdır, lütfen anlayın).

-

- Tatillerde kalabalığa gitmeyin! Bu yerli sırlar Jiuzhaigou'dan daha çekici ve niş, Nisan ayında ziyaret etmelisiniz

-

- Stanford AI, periyodik tabloyu birkaç saat içinde keşfetti ve Zhang Shoushengin ekibi, Turing testinin yerini alacak yeni bir standart tasarlayacak

-

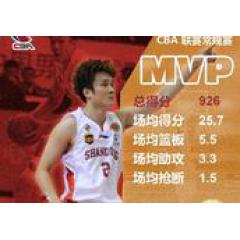

- Ding Yan Yuhang MVP pozisyonunu kazanmaya devam ediyor ve ilk yerel oyuncu kademeli olarak kuruldu. Bir sonraki şey daha önemli

-

- Araba şirketleri ve deniz kuvvetleri söz konusu olduğunda heyecanlısınız, bu seküler bir önyargı mı yoksa insan doğasının çarpıtılması mı?

-

- Hanji'nin schistosomiasis kontrol grubu, şistozomiyaz muayene ve tedavi çalışmalarını aktif olarak yürütür.