Haberler | 12 HCP Lab ödevi, dünyanın en iyi bilgisayarla görme konferansı CVPR 2019 seçildi

HCP Lab 12 makale seçildi

Dünyanın en iyi bilgisayarla görme konferansı

CVPR 2019

En iyi üç küresel bilgisayarla görme konferansından biri CVPR 2019 (IEEE Bilgisayarla Görme ve Örüntü Tanıma Konferansı) planlandığı gibi 16-20 Haziran tarihlerinde ABD'de Los Angeles'ta düzenlendi.

CVPR, bilgisayarla görme konusundaki en iyi üç konferanstan biri olarak her zaman dikkatleri üzerine çekmiştir. CVPR'de yer alan makaleler, bilgisayarla görme alanındaki en son gelişme yönünü ve seviyesini temsil etmektedir. Google Scholar tarafından 2018'de yayınlanan en son akademik dergiler ve konferans etki sıralamasında CVPR 20. sırada yer aldı. Bilgisayar alanında ilk kez bu konferansa giriyor En iyi 20 Sıralar.

Bildiriler açısından, CVPR 2019 yılında toplam 5165 geçerli başvuru aldı ve geçen yılki CVPR2018'e göre% 56 artış gösterdi. Kağıt kabulü açısından bu konferans, kabul oranı% 25,2'ye yakın olan toplam 1.300 bildiri aldı. İstatistiklere göre toplam 288 Sözlü bildiri .

Bu CVPR konferansında Sun Yat-sen Üniversitesi İnsan-Makine-Nesne Akıllı Füzyon Laboratuvarı (HCP Lab) paylaştı 12 makale Makale dahil edilmiştir ve yerli araştırma grubunda en üst düzeydedir. HCP Lab, güçlü bir potansiyele ve güçlü bir ivmeye sahiptir ve akademisyenlerde yeni başarılar elde etme konusunda kendinden emindir.

Aşağıda, herkese gösterilecek birkaç makale seçeceğiz ve ilgilenen arkadaşları okumaya dikkat etmeleri için karşılayacağız.

01

Düşman Meta Uyarlama Ağları Tarafından Harmanlama Hedefi Alan Adaptasyonu

Karşıt eleman adaptasyon ağı aracılığıyla hibrit hedef etki alanı uyarlamasını çözün

Büyük veri çağında, makine öğrenimi bilim insanları, etiketlenmemiş verileri güncelleme ve bu yeni veriler altında modelleri yeniden eğitme sorunuyla karşı karşıya. Etki alanı uyarlama sorunu olarak da bilinen çeşitli etiketlenmemiş verilerin (hedef etki alanı) bilgilerini aktarmak için önceki etiketli verilerin (kaynak etki alanı) nasıl kullanılacağı akademik ve endüstriyel çevrelerde büyük ilgi görmüştür. Sıcak noktaları araştırın. Ne yazık ki, mevcut etki alanı uyarlama sorunu için çözümlerin çoğu, bir veya daha fazla açık hedef etki alanından oluşan hedef etki alanına dayanmaktadır (Şekil 1a). Aslında, otonom sürüş ve bulut veri işleme gibi çeşitli gerçek uygulama senaryoları, çoklu hedef alanların bir karışımı ile alan adaptasyonu problemiyle karşı karşıya kalacaktır (Şekil 1b). Birden fazla hedef alanın karışımında, her hedef veri alt hedef alanlardan birinden gelebilir, ancak hangi alt alandan geldiği bilinmemektedir. Bu nedenle, genel etki alanı uyarlama algoritması doğrudan karma etki alanı uyarlama problemini çözmek için kullanılırsa, eğitimli aktarım öğrenme modeli, karma alt alanlar arasındaki etki alanı kaymasını göz ardı edecektir. Bu, olumsuz geçişe yol açabilir ve modelin etkisine zarar verebilir.

Karma hedef etki alanları sorununu çözmek için, etkili bir model yetiştirmek için etkili etki alanı uyarlaması yapabiliriz, aşağıdaki şekilde gösterildiği gibi karşıt meta-uyarlama ağ modelini (Karşıt Meta-Uyarlama Ağları, AMEAN) öneriyoruz:

AMEAN modeli, iki karma eğitim aktarımı öğrenme süreciyle oluşturulmuştur. İlk bölüm, mevcut etki alanı uyarlama algoritmasından esinlenmiştir, yani öğrenmeyi doğrudan kaynak etki alanı ile karışık hedef etki alanı arasında aktarır. Bu işlem, kaynak etki alanının kategori bilgilerini etkin bir şekilde hedef etki alanına taşıyabilir, ancak birden çok alt hedef etki alanı arasındaki etki alanı farkını ortadan kaldıramaz. Hedef alt alanlar arasındaki fark ne kadar büyükse, karışık hedef alanların neden olduğu negatif göç fenomeni o kadar barizdir. Bu sorunun üstesinden gelmek için bir meta-alt hedef etki alanı uyarlama süreci oluşturduk. Karma hedef etki alanlarının ayarlanması altında, her hedef alt etki alanı açıkça belirtilmediğinden, etki alanı ofsetini doğrudan cezalandırmanın bir yolu yoktur. Bunun yerine, karma hedef etki alanını bölmek için kapsamlı denetimsiz kümeleme algoritmasını (Denetimsiz Meta Öğrenici) kullanırız ve her kümeleme sonucunu alt hedef etki alanının bir ikamesi olarak ele alırız. Ardından, bu alt hedef alanlar ve kaynak hedef etki alanı için aktarım öğrenimini birlikte gerçekleştirmek için karşıt etki alanı adaptasyonu yöntemini kullanın. Her yineleme aralığından sonra, geri bildirimi öğrenmede karma hedef etki alanı geçiş özelliğini kullanıyoruz, kümeleme sonuçlarını karma hedef etki alanının verileriyle yeniden güncelliyoruz ve ardından meta-alt etki alanı uyarlama sürecinde ve bununla ilgili göç karşıtı öğrenme ilişkisini dinamik olarak oluşturuyoruz. Kayıp işlevi. Kümeleme süreci, yakınsamaya kadar iki karma eğitimin aktarım öğrenme süreciyle dönüşümlüdür.

Deneysel sonuçlarımız, hibrit hedef alan adaptasyonunun aslında genel alan adaptasyon algoritmaları için çeşitli negatif transfer fenomenlerine neden olacağını göstermektedir.Aynı zamanda, AMEAN modelimiz hibrit hedef alan adaptasyonunun neden olduğu negatif transfer etkisinin etkin bir şekilde üstesinden gelebilir, böylece mevcut Bu yeni problem altında en iyi performans. Ancak yeni bir aktarım öğrenme problemi olarak, hibrit hedef alan adaptasyonu çözüm noktasına yaklaşmaktan uzaktır.

Orijinal kod bağlantısı: https://github.com/zjy526223908/BTDA

02

Sahne Grafiği Üretimi için Bilgiye Yerleşik Yönlendirme Ağı

Sahne grafiği üretimi için bilgiye gömülü yönlendirme ağ modeli

Sahne grafiği oluşturmanın yalnızca görüntüdeki nesnelerin konumunu ve kategorisini bulması ve tanımlaması değil, aynı zamanda farklı nesneler arasındaki görsel ilişki hakkında daha fazla mantık yürütmesi gerekir. Bununla birlikte, gerçek sahnelerdeki nesne ilişkilerinin örnek dağılımı çok dengesizdir Mevcut yöntemler daha fazla örnekle ilişkiler için daha iyi sonuçlar elde edebilir, ancak örneklerden yoksun ilişkiler için tahmin sonuçları önemli ölçüde azalır. Hedef nesneler arasındaki ilişki ve bunların sahnedeki olası görsel ilişkileri hakkındaki önceki bilgiler, hedef nesnelerin görsel ilişkisinin tahmin alanını sınırlandırmak için grafik yayılma ağı ile birleştirilir, böylece örneklere bağımlılığı azaltır. Bu nedenle, hedef nesnelerin rolünü ve bunların istatistiksel ön bilginin kısıtlamaları altında olası görsel ilişkilerini keşfetmek, aynı zamanda sahnedeki bağlamsal bilgileri araştırmak ve sahne grafiği oluşturma görevlerini uygulamak için bilgiye gömülü bir yönlendirme ağı modeli öneriyoruz.

Model ilk olarak, tüm nesne bölgelerini ilişkilendiren bir grafik oluşturmak için nesnenin bir arada varoluşuna ilişkin önceki bilgileri kullanır ve düğüm bilgilerini yaymak için bir grafik yayılma ağı sunar ve nesne kategorilerini daha iyi tahmin etmeye yardımcı olmak için bağlam bilgisiyle özellikleri öğrenir. Belirli bir kategori etiketine sahip hedef nesneler için, model ayrıca bunlar ve olası görsel ilişkiler arasındaki istatistiksel korelasyonun bir grafiğini oluşturur ve hedef nesnenin görsel ilişkisini nihayetinde tahmin etmek için ikisi arasındaki etkileşimi keşfetmek için başka bir grafik yayılım ağı sunar.

Mevcut yöntemlerle karşılaştırıldığında, bu makaledeki model, farklı ilişkilerin eşit olmayan dağılımı sorununu etkin bir şekilde çözerek, ön bilgileri sunarak hedef nesnenin olası tahmin alanını örtük olarak sınırlar. Büyük ölçekli sahne grafikleri tarafından oluşturulan Visual Genom veri seti üzerinde yapılan çok sayıda deney, bu makalenin çerçevesinin mevcut yöntemlerden daha iyi sonuçlar verdiğini göstermektedir.

Kağıt kodu bağlantısı:

https://github.com/HCPLab-SYSU/KERN

03

Uyarlanabilir Şekilde Bağlı Sinir Ağları

Uyarlanabilir bağlantı sinir ağı

Geleneksel evrişimli sinir ağını (CNN) iki yönden geliştiren yeni bir uyarlanabilir bağlantı sinir ağı (ACNet) sunuyoruz. Birincisi, ACNet'in, uyarlamalı yerel çıkarım veya küresel çıkarım gerçekleştirmek için bir nöron bağlantısının küresel bir bağlantı mı yoksa yerel bir bağlantı mı olduğunu uyarlamalı olarak belirleyebilmesidir. Mevcut evrişimli sinir ağı (CNN), klasik çok katmanlı algılayıcı (MLP) ve yakın zamanda önerilen yerel olmayan alan ağının (NLN) ACNet'in özel durumları olduğunu kanıtlayabiliriz. İkincisi, ACNet'in yalnızca geleneksel Öklid verilerine (görüntüler, ses vb.) Değil, aynı zamanda Öklid dışı verilere de (grafik verileri) uygulanabilir olmasıdır. Deneyler, ACNet'in ImageNet-1K / CIFAR görüntü sınıflandırması, COCO 2017 hedef tespiti ve segmentasyonu, CUHK03 yaya yeniden tanıma ve CORA belge sınıflandırması gibi görevlerde son teknoloji efektler elde ettiğini gösteriyor.

Spesifik olarak, araştırmacılar önce piksel düzeyinde özellikleri çıkarmak için kendi kendine dönüştürme işlemini (Self Trans modülü), yerel özellikleri çıkarmak için evrişim işlemini (CN N modülü), global özellikleri çıkarmak için çok katmanlı algılayıcı işlemi (MLP modülü) kullanır ve ardından uyarlanabilir Yerel ve küresel uyarlanabilir özellikler elde etmek için üçünü birleştirmek için sinir ağını (ACNET modülü) bağlayın, böylece ACNet yalnızca kendi kendini dönüştürme işlemi ve evrişim işleminin yerel çıkarım yeteneğine sahip olmakla kalmaz, aynı zamanda çok katmanlı algılayıcı işleminin küresel çıkarım yeteneğine de sahiptir. kabiliyet.

Kodu ve önceden eğitilmiş modeli indirin:

https://github.com/wanggrun/Adaptively-Connected-Neural-Networks/blob/master/README.md

04

"3B İnsan Duruşu Tahmini için Geometri Bilinçli Temsilin Zayıf Denetimli Keşfi"

Yapısal temsile dayalı zayıf denetimli 3B insan pozu tahmini

3D insan pozu tahmini, tek bir renkli görüntüden doğru 3D insan pozunu kurtarmayı amaçlayan, bilgisayar görüşü alanında sıcak bir araştırma konusudur. 3D insan vücudu yapısı modellemesinin temeli olarak, 3D insan vücudu poz tahmini, eylem tanıma, video analizi, insan-bilgisayar etkileşimi, sanal gerçeklik ve otonom sürüş alanlarında çok önemli bir rol oynar. Son yıllarda, 3D insan pozu tahmini büyük ilerleme kaydetti. Bununla birlikte, ilgili veriler ve model yöntemleri, bu araştırma probleminin araştırılmasını büyük ölçüde sınırlayan basit iç mekan sahneleriyle sınırlıdır. Bunun ana nedeni, karmaşık dış mekan sahnelerinde 3 boyutlu insan vücudu veri setlerinin toplanmasının çok zor olmasıdır.Mekan üzerindeki optik hareket toplama sisteminin katı gereksinimleri nedeniyle, yalnızca iç mekan sahnelerinde basit insan hareketlerini yakalayabilir. Test verilerinde zor insan duruşları, rahatsız edilmiş çekim açıları, çeşitli insan görünümleri ve karmaşık çekim sahneleri olduğunda, 3B insan duruş tahmin modelinin genelleştirilmesi genellikle zayıftır.

Bu amaçla, bu makale çok sayıda çoklu-görüntülü görüntüden ek 3B insan vücudu yapısı bilgisi çıkarmak ve tek bir görüntüde 3B insan pozu tahmini görevine yardımcı olmak için ek bilgileri kullanmak için bir çözüm önermektedir. Ek bilgilerin çıkarılması sürecinde, eğitim seti olarak yalnızca 2D açıklamalı çoklu görüntülü görüntüler kullanılır, kodek omurga ağı olarak seçilir ve codec, 2D insan vücudu bilgilerinin farklı görünümler altında karşılıklı dönüşümünü gerçekleştirmek için eğitilir. Dönüşümü sadece insan vücut yapısına göre yapmak için, bu yazıda orijinal görüntü yerine yöntemin 2D insan vücudu bilgisi olarak 2D insan iskeleti seçilmiştir. Çıkarılan ek bilgilerin 3B yapısını daha kararlı hale getirmek için 3B yapı üzerindeki tutarlılık kısıtlaması da eklenmiştir. Çıkarılan ek bilgiler insan vücudunun 3B yapı bilgilerini içerdiğinden, bunları doğrudan 2B görüntüler veya 2B koordinatlar kullanmaktan 3B anahtar nokta koordinatlarına eşlemek daha kolay olacaktır. Daha sonra, yalnızca basit iki katmanlı doğrusal, tamamen bağlantılı bir katman kullanmanın, ek bilgilerden nispeten makul bir 3D insan pozunun kodunu çözebileceği doğrulandı.

Deneysel doğrulamadan sonra, bu makalede çıkarılan ek bilgiler, 3B insan pozu bilgilerine ek olarak kullanılabilir ve daha doğru tahmin sonuçları elde etmek için mevcut 3B insan pozu tahmin yöntemlerine basit ve esnek bir şekilde entegre edilebilir. Standart büyük ölçekli 3D insan vücudu veritabanı Human3.6M'de, bu makalede çıkarılan ekstra bilgiler, üç farklı 3D insan pozu tahmin yöntemini büyük ölçüde geliştirir. Standart veri bölümü altında MPJPE değerlendirme endeksini kullanan mevcut en iyi açık kaynaklı 3B insan pozu tahmin yöntemi için, bu makalede önerilen yöntem hala% 7'lik bir iyileştirmeye sahiptir ve mevcut yöntemler arasında en iyi etkiyi elde etmektedir.

05

Akıl Yürütme-RCNN: Uyarlanabilir Küresel Akıl Yürütmeyi Büyük Ölçekli Nesne Algılamayla Birleştirme

Genel uyarlanabilir küresel muhakeme ağı ve büyük ölçekli hedef tespitinde uygulaması

Derin öğrenmenin gelişmesiyle birlikte, büyük ölçekli hedef tespiti sorunu giderek sıcak bir ilgi konusu haline geldi.Bilgisayarla görmedeki bu temel teknoloji sayesinde, yazılım ve donanım uygulamaları, resimdeki nesnelerin konumunu ve kategorisini derinlemesine bulabilir ve yeni perakende ve genel amaçlı olarak kullanılır. Çok parçalı tanıma ve otomatik sürüş gibi sahneler. Sıradan tespit problemlerinden farklı olarak, büyük ölçekli hedef tespiti, aynı anda binlerce kategorinin konumlandırılması ve tanımlanması, ciddi uzun kuyruk etkileriyle, hedefler arasında karşılıklı tıkanma ve daha belirsiz hedefler anlamına gelir. Bununla birlikte, ana akım hedef tespit yöntemleri genellikle her bölgeyi bağımsız olarak tanımlar ve sahnedeki hedefler arasındaki temel anlamsal korelasyonu göz ardı ederek, karmaşık ve büyük ölçekli verilerle karşılaştıklarında tespit performanslarında önemli bir düşüşe neden olur. İnsanlar, karmaşık sahneleri gördüklerinde bile hedefleri doğru bir şekilde anlayabilir ve tanıyabilir, çünkü insanlar birçok ilgili bilgi alanının sağduyu bilgisini anlar ve bilgiyi öğrenmek ve akıl yürütmek için kullanabilir; bu, mevcut algılama sistemlerinde eksiktir. Bu nedenle, anahtar soru, algılama sistemine insan muhakeme sürecini taklit etmek için görsel muhakeme yeteneğinin nasıl kazandırılacağıdır.

Bu makale, bilgi odaklı görüntü düzeyinde uyarlanabilir küresel akıl yürütme yöntemini inceler ve tüm hedef bölgeler için uyarlanabilir küresel muhakeme yeteneğini bilgi yoluyla geliştiren evrensel bir uyarlanabilir küresel muhakeme modeli (Akıl Yürütme-RCNN) önerir. Bu yöntem, görsel özellikleri tek bir görüntü üzerinde doğrudan yaymaz, ancak görüntüdeki gürültü veya istenmeyen görsel özelliklerin etkilerinden kaçınmak için tüm yüksek düzeyli anlamsal gösterimleri küresel olarak geliştirir. Spesifik olarak, temel algılama ağının özellik temsiline dayalı olarak, önerilen ağ ilk olarak üst sınıflandırma katmanının ağırlıklarını toplayarak her kategori için genel anlamsal havuzu oluşturur ve ardından küresel anlam havuzundan farklı anlamsal bağlamları seçer. Her bir hedef alanın özelliklerini uyarlanabilir bir şekilde geliştirin. Bu makalede önerilen Akıl Yürütme-RCNN gürültülü olabilecek tüm anlamsal bilgi türlerinden bilgi yaymaz, ancak özellik gelişimi için en uygun kategorileri otomatik olarak bulabilir.

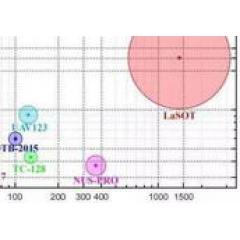

Deneysel doğrulamadan sonra, bu makalede önerilen yöntem hafif, evrensel ve genişletilebilirdir ve herhangi bir algılama ağına görsel akıl yürütme yeteneği kazandırmak için bilgiyi entegre edebilir. Çok fazla hesaplama maliyeti getirmeden, bu yazıda önerilen yöntem, büyük ölçekli algılama veri setleri VisualGenome (1000 kategori / 3000 kategori), ADE (445 kategori) ve genel algılama veri setleri MS COCO (80 kategori), PASCAL VOC ( 20 kategori) diğer mevcut gelişmiş algılama yöntemlerinden çok daha üstündür.

06

Büyük Ölçekli Nesne Algılama için Uzamsal Farkındalıklı Grafik İlişkisi Ağı

Uzaya duyarlı grafik ilişkisel ağı ve büyük ölçekli hedef tespitinde uygulaması

Büyük ölçekli hedef tespit çerçevelerinin, karmaşık anlamlara ve uzamsal ilişkilere sahip binlerce hedefi eşzamanlı olarak bulup tanıyabilmesi gerekir.İşlenecek kategorilerin sayısı arttıkça, hedefler ne kadar küçük ve kategoriler arasındaki hedef sayısı o kadar ciddi olur. Hedefler arasında dengesizlik ve karşılıklı tıkanma gibi sorunlar. Hepimizin bildiği gibi, hedefler arasındaki karmaşık anlamsal ve mekansal ilişki, tespit doğruluğunu iyileştirmeye yardımcı olabilir. Ancak, mevcut araştırma çalışmalarının çoğu genellikle hedefi ayrı ayrı konumlandırır ve tanır.Bu yöntemler büyük ölçekli kategori veri setleriyle karşılaştığında, performansları büyük ölçüde azalacaktır. Bu nedenle, bu makale, her bir nesne hakkında akıl yürütmek için anahtar anlambilim ve göreli uzamsal ilişkileri aktif olarak keşfetmek ve birleştirmek için mekansal olarak farkında bir grafik ilişkisel ağ (SGRN) çerçevesi önermektedir. Yöntemimiz göreceli konum düzenini ve hedefler arasındaki etkileşimi hesaba katar Önerdiğimiz SGRN, mevcut herhangi bir algılama yöntemine kolayca yerleştirilebilir ve algılama performansını iyileştirebilir.

Herhangi bir dış bilgi olmadan, algılama sistemindeki nesneler arasındaki yüksek dereceli ilişkiler nasıl doğru şekilde kodlanır? Daha iyi çıkarımlar yapmak için nesnelerin birleşik ilişkileri ve göreli konumları arasındaki bilgi nasıl kullanılır? Bu sorunlar, günümüzün büyük ölçekli hedef tespit çerçevesinin karşılaştığı ana zorluklardır. Son zamanlarda, bazı çalışmalar, hedefler arasında bir bilgi grafiği oluşturarak algılama etkisini artırmaya çalışmıştır.Şekil 1a, sınıflar arasında bir grafik oluşturmak için yapay olarak tasarlanmış bilgiyi kullanır. Bununla birlikte, bu yöntem ağırlıklı olarak nitelik etiketlemeye ve geniş kategori vizyonundan anlamsal ilişkilere dayanır. Ek olarak, anlambilim ve görsel bağlam arasındaki fark nedeniyle, belirli uzamsal ilişkiler göz ardı edilebilir ve sabit görüntüler tüm görüntülere sığamaz. Diğer yöntemler, görsel özelliklerden hedefler arasında tamamen bağlantılı grafiği örtük olarak öğrenmeye çalışır. Bununla birlikte, tamamen bağlantılı ilişkiler, ilgisiz nesnelerden ve arka plandan gereksiz ve gereksiz ilişkilerin dahil edilmesi nedeniyle verimsiz ve gürültülü hale gelir. Bu nedenle, bu makalenin amacı, yorumlanabilir seyrek grafik yapılarını doğrudan eğitim setinden etkili bir şekilde öğrenmek için anlambilim ve uzamsal ilişkileri eşzamanlı olarak kullanabilen ve öğrenilen grafik yapısını temel alan grafik evrişimli sinir ağlarına dayalı bir algılama çerçevesi tasarlamaktır. Çıkarım yapın ve yayılımı yapın ve tespit sonuçlarını buna göre iyileştirmek için küçük hedeflerin, nadir sınıfların ve bulanık kapatılmış hedeflerin özelliklerini geliştirin.

Bu yazıda önerilen SGRN çerçevesi iki modülden oluşmaktadır: bir İlişki Öğrenici modülü ve bir Uzamsal Grafik Akıl Yürütme modülü. İlişki grafiği öğrenme modülü, ilk olarak en alakalı T bağlantı ilişkilerini koruyan görsel özelliklerden seyrek bir bitişik matris öğrenir. Daha sonra, önceki sınıflandırıcının ağırlığı toplanır ve her hedefin görsel vektörü olması için her hedefe eşlenir. Hedefler arasındaki göreceli uzamsal bilgi (mesafe, açı), grafik evrişim modelini belirlemek için Gauss çekirdek parametrelerini öğrenmek için kullanılır. Uzaysal algı grafiği muhakeme modülünde, farklı bölgelerdeki görsel gömme, seyrek bitişik matris ve Gauss çekirdeğine göre geliştirilir ve yayılır. Uzamsal harita çıkarım modülünün çıktısı, sınıflandırmayı ve konumlandırmayı geliştirmek için orijinal alan özellikleriyle bağlantılıdır.

07

Grafonomi: Grafik Transfer Öğrenimi ile Evrensel İnsan Ayrıştırma

Genel insan analizi için grafik aktarım modeli

İnsan görsel sistemi, sadece karakterin görüntüsüne bakarak görüntüdeki karakterlerin genel anlayışını tamamlama yeteneğine sahiptir. Örneğin insanlar resimdeki karakterleri sadece resme bakarak arka plandan ayırt edebilmekte, resimdeki karakterlerin duruşunu bilebilmekte, resimdeki karakterlerin kıyafetlerini ve elbiselerini de tanıyabilmektedir. Bununla birlikte, karakter imgesinin anlaşılmasına ilişkin son araştırmalar, karakter ön plan bölümleme görevleri, kaba giysi bölümleme görevleri ve ince karakter parçaları veya giysi analizi görevleri gibi her bir uygulama için çok sayıda son derece bağımsız spesifik modelin geliştirilmesine adanmıştır. . Bu yüksek derecede ayarlanmış ağlar, modelin genelleme yeteneğini feda eder ve insan vücudunun potansiyel yapısal özelliklerini ve tüm insan görüntülerinde ortak iç semantiği göz ardı ederken, yalnızca farklı veri setlerine ve tutarsız açıklama ayrıntılarına uyum sağlar. bilgi. Bir veri kümesi üzerinde eğitilmiş bir modeli doğrudan başka bir ilgili veri kümesi üzerinde yeniden ayarlamak çok zordur, çünkü her bir modeli yeniden eğitmek için fazladan ve yoğun veri açıklaması ve çok sayıda bilgi işlem kaynağı gerektirir. Bu pratik zorlukları çözmek ve ilgili görevler için gereksiz modelleri eğitmekten kaçınmak için, genel insan analizi sorununu incelemek için yenilikçi bir girişimde bulunduk ve aynı anda farklı olan, kaba taneden ince taneliye kadar tek bir model kullandık. İnsan vücudu analizi görevi aşağıdaki şekilde gösterilmektedir.

Genel bir insan analizi modelinin tasarlanmasındaki anahtar faktör, farklı insan analizi görevleri arasında doğru aktarım öğrenimi ve bilgi entegrasyonu gerçekleştirmektir, çünkü farklı veri setleri arasındaki etiket farkı, model ve verilerin birleştirilmesini büyük ölçüde engeller. Bu hedefe ulaşmak için, insan bilgisini ve etiket sınıflandırmasını grafik gösterimi öğrenmede açıkça özetleyen ve bunu evrişimli sinir ağına yerleştiren bir grafik aktarım modeli öneriyoruz. Grafik aktarım modelimiz, çok seviyeli insan vücudu analizi görevlerini çözmek ve bilgi yayma yoluyla birbirlerini teşvik etmelerini sağlamak için birden çok alanda küresel ve genel anlamsal tutarlılığı modellemek için grafik aktarımı öğrenmeyi kullanır.

Grafik aktarım modelimiz, aşağıdaki şekilde gösterildiği gibi, grafik aktarımı öğrenimi için iki birlikte çalışan modülü entegre eder. İlk olarak, grafik yapısındaki grafik temsilini kademeli olarak iyileştirmek için bir grafik içi muhakeme modülü öneriyoruz, burada her grafik düğümü veri setinde bir anlamsal bölümü temsil eder. Buna ek olarak, bir alanın temsilinden başka bir alanın temsiline ilgili anlambilimini çıkarmaya odaklanan, böylece farklı veri kümelerindeki anlamsal etiketleri birbirine bağlayan ve daha iyi kullanılmasını sağlayan bir grafikler arası geçiş modülü oluşturduk. Farklı ayrıntı düzeylerinin etiketli bilgileri.

Farklı türde anlamsal parçalar ve giysi etiketleri içeren üç insan vücudu analiz veri seti üzerinde çok sayıda deney yaptık. Deneysel sonuçlar, grafikteki muhakeme modülünün bilgi yayılımı ve grafikler arasındaki geçiş modülü aracılığıyla, grafik geçiş modelimizin farklı veri setlerinden oluşturulmuş yüksek seviyeli anlamsal grafik ifadelerini ilişkilendirip çıkarabildiğini ve çok seviyeli genel insan vücudu analiz görevlerini etkili bir şekilde çözebildiğini göstermektedir. .

08

ClusterNet: Nokta Bulutu Analizi için Titizlikle Döndürmeyle Değişmeyen Temsili Derin Hiyerarşik Küme Ağı

Sıkı dönüş değişmezliği nokta bulutu ifadesine ve derin hiyerarşik küme ağına dayalı bir nokta bulutu analiz yöntemi

Üç boyutlu dünyada, rotasyon dönüşümü çok doğal ve yaygın bir fenomendir, ancak aynı zamanda üç boyutlu nesne tanımaya büyük zorluklar da getirir. Teorik olarak, SO (3) grubu sonsuz bir küme olduğundan, aynı üç boyutlu nesnenin farklı pozlarda farklı "klonları" vardır. İnsanlar için, bu "klonları" aynı nesne olarak kolayca yargılayabiliriz, ancak makine öğrenimi modelleri için bu klonlar tamamen farklı girdi verileridir ve bu da çok büyük bir girdi alanıyla sonuçlanır.

Bu sorunu hafifletmek için daha önce birçok girişimde bulunulmuştur. En basit yöntemlerden biri, model kapasitesini artırmak ve eğitim veri setinde rotasyon geliştirme yapmaktır.Bu yöntem, eğitim aşamasının hesaplama maliyetini büyük ölçüde artırır ve modelin rotasyon değişmezliğine sahip olduğunu temelden garanti edemez. Aynı nesnenin belirli bir pozu için model doğru bir şekilde tanımayabilir. Giriş verilerini düzeltmek için Mekansal trafo ağını kullanmak Bu yöntem, modelin dönüş sağlamlığını bir dereceye kadar artırabilir, ancak aynı zamanda eğitim setini geliştirmesi gerekir ve ayrıca teorik garantilerden yoksundur. Rotasyonun model üzerindeki etkisini ortadan kaldırmak için rotasyona eşdeğer ağın kullanılması. Sinir ağına önceden eşit dönüş bilgisinin eklenmesine eşdeğer, dönüşe eşit bir evrişim işlemi tasarlar, ancak sinir ağının her katmanına eşit dönüş kısıtlaması uygulanırsa, bizim için zordur. Bu kısıtlamaların modelin kapasitesini etkilemeyeceğinden emin olun.

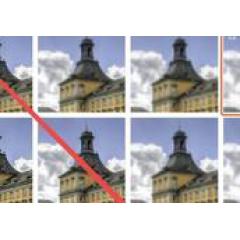

Dönüş eşdeğer ağından farklı olarak, yeni bir çözüm öneriyoruz: her üç boyutlu nesnenin nokta bulutu için doğrudan dönüşle değişmeyen birleşik bir ifade (RRI ifadesi olarak adlandırılır) oluşturun ve rotasyon problemini doğrudan kaynaktan çözün. Orijinal yedek girdi alanı büyük ölçüde azaltılır. Bu ifadenin katı dönme değişmezliğine sahip olduğunu sadece teorik olarak kanıtlamakla kalmadık, aynı zamanda daha zayıf koşullar altında bilgi kayıpsızlığı da var, yani: nokta bulutu nasıl döndürülürse döndürülsün, bir nokta bulutunun RRI ifadesini bildiğimizde, Döndürülmüş nokta bulutundaki bir noktanın koordinatları ve eş doğrusal olmayan en yakın komşu nokta verildiğinde, döndürülmüş nokta bulutunu yeniden oluşturabiliriz. RRI ifadesinin spesifik formu, Şekil 1'de gösterildiği gibi sezgisel geometrik anlama da sahiptir.

Şekil 1: RRI ifadesi. Örnekte nokta bulutunda 3 nokta vardır (3 renkle temsil edilir) ve bir 2-NN grafiği oluşturulmuştur.

Ayrıca, Şekil 2'de gösterilen ClusterNet adlı yeni bir ağ yapısı önerdik. Nokta bulutunun geometrik yapısı hakkında hiyerarşik bir kümeleme ağacı elde etmek için önce giriş noktası bulutu üzerinde hiyerarşik kümeleme gerçekleştirir. Daha sonra, özelliklerin bir araya getirilmesine rehberlik etmek için bu hiyerarşik kümeleme ağacını izliyoruz ve tüm nokta bulutunun özellikleri elde edilene kadar daha küçük kümelerin özelliklerini aşağıdan yukarıya daha büyük kümelerin özelliklerinde bir araya getiriyoruz.

Şekil 2: ClusterNet ağ mimarisi

Rotasyon sağlamlığı deneyinde, önerdiğimiz RRI ifademiz ve ClusterNet'in kombinasyonu, rotasyon sağlamlığında en iyi performansı elde etti ve mevcut nokta bulutu tabanlı sınıflandırma ağı girdi olarak RRI ifademizi kullanıyor. Dönme sağlamlığı da önemli ölçüde geliştirildi.

09

Moda Dönüm Noktası Tespiti için Düzen-grafik Akıl Yürütme

Yığılmış hiyerarşik düzen bilgisi muhakemesine dayalı bir giysi kilit noktası konumlandırma yöntemi

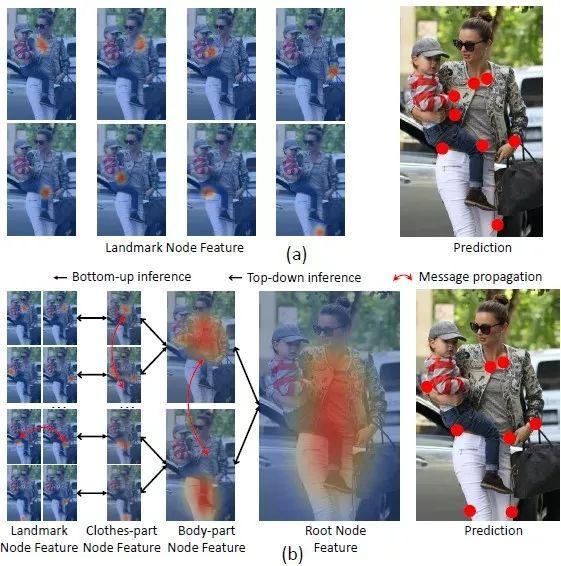

Son zamanlarda, kilit noktaları tahmin etmek ve konumlandırmak için birçok araştırma yöntemi olmuştur. Doğrudan bir yöntem, Şekil 1 (a) 'da gösterildiği gibi, anahtar noktaların konum bilgilerini uçtan uca modellemek için DCNN'leri kullanmaktır. Bu yöntem derin evrişimli ağların derin modelleme yeteneklerinden yararlanmasına rağmen, yorumlanabilirlikten yoksundur, veri bağımlılığına duyarlıdır ve karmaşık arka plana sahip bazı sahnelerde kötü performans gösterir. Dilbilgisi modellemesini tanıtmanın bir başka yolu da, boyun çizgisinin simetrik bir dilbilgisi oluşturmak gibi, giyimin kilit noktaları arasındaki grameri modellemek ve ardından Şekil 1 (b) 'de gösterildiği gibi ağ öğrenmesine rehberlik etmek için dilbilgisinin oluşturduğu kısıtlamaları kullanmaktır. . Modelleme için harici özel dilbilgisi tanıtmanın bu yöntemi, anahtar noktaların konumlandırılmasının performansını etkili bir şekilde iyileştirebilir ve ağın yorumlanabilirliğini artırabilir, ancak bu yöntem, mekansal bağlamı ve noktaların anlamsal ilişkisini modellemek için bilgi sağlamaz, örneğin Üst vücut semantik ilişkisi. Bu ilişkinin olmaması, bazı karmaşık ve bulanık sahnelerde üst ve alt vücut kıyafetlerinin kilit noktalarının tahmininde kolayca kafa karışıklığına yol açar. Aynı zamanda, mevcut yöntem, evrişimli özellik haritasını ve grafik düğümünün özelliğini modellemek için etkili bir dönüştürme yöntemine sahip değildir, böylece bilgi grafiğindeki düğümün bilgi muhakeme operasyonu, evrişimli ağ ile etkin bir şekilde sorunsuz bir şekilde bağlanamaz, böylece işbirliğine dayalı eğitim elde edilemez. Amacı.

Şekil 1 Bu yöntem (b) ile mevcut yöntem (a) arasındaki karşılaştırma

Var olan teknolojinin eksikliklerinin üstesinden gelmek ve bir şeyleri anlama sürecinde bir şeyleri sınıflandırmak için insan fikrinden yararlanmak için, ilk önce yığılmış hiyerarşik düzen bilgi muhakemesine dayalı olarak giysinin kilit noktalarını konumlandırmak için bir yöntem önerdik. Genel çerçeve aşağıdaki gibidir. Şekil 2'de gösterildiği gibi. Genel çerçeve temelde temel bir evrişimli ağ ve bir dizi hiyerarşik yerleşim bilgi muhakeme modülünü (LGR katmanı) içerir. Her hiyerarşik yerleşim bilgi muhakeme modülü, üç alt modül içerir: Eşlemden Düğüme, Yerleşim Grafiğine İlişkin Muhakeme Modülü ve Düğümden Haritaya . Her hiyerarşik muhakeme alt modülü, grafik düğümü kümeleme işlemlerini, grafik düğümü ters evrişim işlemlerini ve grafik düğümü bilgi yayma işlemlerini içerir. Bu yöntem, giriş görüntüsünün evrişim özelliği haritasını çıkarmak için ilk olarak temel evrişimli ağı kullanır ve daha sonra evrişim özellik haritasını grafik düğüm özelliğine dönüştürmek için grafik noktası alt modülünü kullanır; daha sonra grafik düğüm özelliklerini birleştirmek için giyim anahtar noktası uzamsal yerleşim ilişkisi bilgilerini kullanır, Şekil 3'te gösterildiği gibi, her bir yaprak düğümün mizanpaj ilişkisini, her bir ara düğümün mizanpaj ilişkisini, vb. Dahil olmak üzere hiyerarşik yerleşim bilgisi çıkarımını gerçekleştirmek için hiyerarşik çıkarım alt modülüne girdi, nihai çıktı evrimsel olarak geliştirilmiş yaprak düğüm özellikleridir; son olarak noktadan- Grafik alt modülü, hiyerarşik çıkarım alt modülünün çıktı düğümlerini bir evrişimli özellik haritasına dönüştürür; daha sonra evrişimli özellik haritası, giysinin kilit noktalarının nihai konumunu tahmin etmek için son işlem yoluyla bir özellik konum haritasına dönüştürülür.

Şekil 2 Yöntemin genel çerçevesi

Şekil 3 Hiyerarşik düzen bilgisi muhakeme modülü (LGR katmanı)

Bu yöntem ilk kez bir hiyerarşik yerleşim bilgisi muhakeme yöntemi önerir ve bu yöntemi ilk kez genel giyim anahtar noktası konumlandırma görevine uygular. Çok aşamalı tahmin, uzamsal dönüşüm ve anahtar nokta konumlandırmasını kısıtlamak için dilbilgisi modelleri kullanan anahtar nokta konumlandırma yöntemlerine dayanan son dikkat mekanizmasıyla karşılaştırıldığında, önerdiğimiz yöntem yalnızca daha yüksek konumlandırma doğruluğu ve yorumlanabilirliğe sahip olmakla kalmaz, aynı zamanda Hiyerarşik akıl yürütme için evrişimli ağlara hiyerarşik bilgi grafiklerini tanıtmak için bir mekanizma. Yöntemimiz, mevcut iki büyük moda dönüm noktası veri seti üzerinde test edildi ve son teknoloji ürünü etkiyi elde etti.

ek

1. "Karşıt Meta Uyarlama Ağları ile Harmanlama Hedefi Alan Adaptasyonu", Ziliang Chen, Jingyu Zhuang, Xiaodan Liang ve Liang Lin Proc., IEEE Konferansı Bilgisayar Vizyonu ve Örüntü Tanıma (CVPR), 2019.

2. "Sahne Grafiği Üretimi için Bilgiye Yerleşik Yönlendirme Ağı", Tianshui Chen, Weihao Yu, RIquan Chen, Liang LinProc. Of IEEE Conference onComputer Vision and Pattern Recognition (CVPR), 2019.

3. "Adaptively Connected Neural Networks", Guangrun Wang, Keze Wang ve Liang Lin *, Proc. Of IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2019.

4. "3B İnsan Duruşu Tahmini için Geometriye Duyarlı Temsilin Zayıf Denetimli Keşfi", Xipeng Chen, Kwan-Yee Lin, Wentao Liu, Chen Qian ve Liang Lin, IEEE Proc. Of Computer Vision and Pattern Recognition (CVPR) , 2019

5. "Akıl Yürütme-RCNN: Büyük Ölçekli Nesne Algılamasında Uyarlanabilir Küresel Akıl Yürütmeyi Birleştirme", Hang Xu *, ChenHan Jiang *, Xiaodan Liang, Liang Lin, Zhenguo Li, Proc. Of IEEE Conference onComputer Vision and Pattern Recognition (CVPR), 2019.

6. "Büyük Ölçekli Nesne Algılama için Uzamsal Farkındalık Grafik İlişkisi Ağı", Hang Xu *, ChenHan Jiang *, Xiaodan Liang, Zhenguo Li, IEEE Proc. OnComputer Vision and Pattern Recognition (CVPR), 2019.

7. Grafonomi: Grafik Transfer Öğrenimi ile Evrensel İnsan Ayrıştırma, Ke Gong, Yiming Gao, Xiaodan Liang, Xiaohui Shen, Meng Wang, Liang Lin, IEEE Proc. OnComputer Vision and Pattern Recognition (CVPR), 2019.

8. ClusterNet: Nokta Bulutu Analizi için Titizlikle Dönme-Değişmez Temsili Derin Hiyerarşik Küme Ağı, Chao Chen, Guanbin Li, Ruijia Xu, Tianshui Chen, Meng Wang, Liang Lin, IEEE Proc. OnComputer Vision and Pattern Recognition (CVPR) , 2019.

9. "Moda Dönüm Noktası Tespiti için Düzen-Grafik Akıl Yürütme", Weijiang Yu, Xiaodan Liang, Ke Gong, Chenhan Jiang, Nong Xiao, Liang Lin; Bilgisayarla Görü ve Örüntü Tanıma IEEE Konferansı (CVPR), 2019

10. "Yönlendiren İfadeleri Temellendirmek İçin Çapraz Modal İlişki Çıkarımı", Sibei Yang, Guanbin Li, Yizhou Yu; Bilgisayarla Görme ve Örüntü Tanıma IEEE Konferansı (CVPR), 2019

11. "Yapılandırılmış Bilginin Kılavuzluğunda Kişiselleştirilmiş Modüler Ağı Öğrenme", Xiaodan Liang; Bilgisayarla Görme ve Örüntü Tanıma IEEE Konferansı (CVPR), 2019

12. "Zero-Shot Learning için Bilgi Grafiği Yayılımını Yeniden Düşünmek", Michael Kampffmeyer, Yinbo Chen, Xiaodan Liang, Hao Wang, Yujia Zhang, Eric P. Xing; Bilgisayarla Görme ve Örüntü Tanıma üzerine IEEE Konferansı (CVPR), 2019

HCP İnsan-Makine-Nesne Akıllı Füzyon Laboratuvarı, Sun Yat-sen Üniversitesi

"Sun Yat-sen Üniversitesi Sağlık Görevlisi İnsan-Makine-Akıllı Füzyon Laboratuvarı", Sun Yat-sen Üniversitesi Veri Bilimi ve Bilgisayar Okulu'na dayanır, "yapay zeka orijinal ve en son teknoloji" etrafında araştırma yönleri ve konuları ortaya koyar ve çok sayıda orijinal teknoloji üretmek için endüstri ile kapsamlı bir işbirliğine sahiptir ve Birden fazla girişimci ekibi kuluçkaya yatırın. Algısal hesaplama ve akıllı öğrenme, robotlar ve gömülü sistemler, insan-bilgisayar işbirliği teknolojisi, büyük veri madenciliği ve analizi alanlarında araştırmalar yapın ve çalışma felsefesi olarak "akademik zirvelere tırmanma ve zemin uygulama" yı alın. Laboratuvarda şu anda 1 profesör, 4 doçent, 3 seçkin araştırmacı ve 3 mühendis bulunmaktadır.

Laboratuvar, her düzeyde 40'tan fazla bilimsel araştırma projesi üstlenmiş veya tamamlamıştır ve on milyonlarca bilimsel araştırma fonu almıştır. Araştırma ekibi, IEEE / ACM Trans'da 60'tan fazla makale ve CVPR / ICCV / NIPS / Multimedia / AAAI / IJCAI gibi en iyi konferanslarda 100'den fazla makale dahil olmak üzere en iyi uluslararası akademik dergi ve konferanslarda 200'den fazla makale yayınladı. , NPAR 2010 En İyi Bildiri Ödülü, ACM SIG CHI En İyi Bildiri Ödülü, Mansiyon Ödülü, ICME 2014 En İyi Öğrenci Bildirisi, ICME 2017 tarafından Dünyanın İLK 10K En İyi Kağıt Elmas Ödülü, Desen Tanıma En İyi Kağıt Ödülü ve diğer ödülleri kazandı.

2019 Küresel Yapay Zeka ve Robotik Zirvesi

12-14 Temmuz 2019 , Lei Feng.com ve Hong Kong Çin Üniversitesi (Shenzhen) tarafından ortaklaşa düzenlenen ve Shenzhen Yapay Zeka ve Robotik Enstitüsü tarafından ortaklaşa düzenlenen Çin Bilgisayar Federasyonu (CCF) sponsorluğunda 2019 Küresel Yapay Zeka ve Robotik Zirvesi (CCF-GAIR 2019 olarak kısaltılmıştır) Shenzhen'de resmen açılacak.

O sırada Nobel Ödülü sahibi James J. Heckman, Çinli ve yabancı akademisyenler, Dünya Zirvesi Başkanı, tanınmış Fellow ve çok sayıda ağır konuk savaşta yer alacak. Yapay zeka ve robotik bilim, üretim ve yatırım alanlarında karmaşık hayatta kalma durumunu tartışmak.

Bugün 1000 yuan bilet için sadece 5 kupon kodu bulunmaktadır.İlk bilet fiyatı 1999 yuan'dır.Aşağıdaki bağlantılardan herhangi birini kullanabilirsiniz.Kupon sadece 999 yuan kupondan sonra geçerlidir.Sadece 5 bilet vardır, ilk gelen önce alır, stok biter.

https://gair.leiphone.com/gair/coupon/s/5d11f29597d4f

https://gair.leiphone.com/gair/coupon/s/5d11f29597ada

https://gair.leiphone.com/gair/coupon/s/5d11f29597822

https://gair.leiphone.com/gair/coupon/s/5d11f29597549

https://gair.leiphone.com/gair/coupon/s/5d11f295972a6

Tıklamak Orijinali okuyun , Kontrol edin: Bundan beş yıl sonra bilgisayar görüşü nasıl görünecek? CV Öncüleri ile Düşünün (2. Bölüm) | CVPR 2019

-

- Apple, iOS 12.4 Beta 6'yı zorluyor; Huaweinin ilk 5G telefonu Ağustos ayında piyasaya sürülebilir; Sony yeni yankı galerisi ve plak çaları 24 saat piyasaya sürüyor

-

- 190614 Zhu Zhengting'in siyah görünümü havaalanında belirdi ve küpeler nihayet güneşte güneşlenmek için çıkarıldı.