Makineler öğrenmez: Bilgisayar Görme Serisi (1) LeNet-5 ve AlexNet

Makine www.jqbxx.com'u öğrenmiyor: Derin toplu makine öğrenimi, derin öğrenme algoritmaları ve teknik mücadele

ILSVRC olarak anılan ImageNet Büyük Ölçekli Görsel Tanıma Mücadelesi, görüntü sınıflandırma alanında bir yarışmadır. Yılda bir kez düzenlenmektedir. Aşağıdaki şekil, yıllık ödüllü modelleri ve bunların ilk 5 hata oranlarını göstermektedir. Bu makale esas olarak bu modellerin yapısını sıralıyor:

Bir, LeNet-5

LeNet-5, LeCun ve diğerleri tarafından 1998'de belge tanımaya uygulanan Gradient tabanlı öğrenme makalesinde önerilen el yazısı tanıma için bir evrişimli sinir ağı modelidir. Evrişimli sinir ağlarının öncü çalışmasıdır. Model yapısı, mevcut popüler ağdan biraz daha basittir, ancak bileşenleri, evrişimli katman, havuzlama katmanı ve tamamen bağlı katman, daha sonraki CNN ağının bir parçasıdır. Bununla birlikte, hesaplama gücünün sınırlandırılması ve destek vektör makinesinin o zamanki sınıflandırma yeteneği nedeniyle, kapsamlı derinlemesine araştırma ve ilgiye neden olmadı. İlk önce yapı şemasına bakın:

- GİRİŞ: giriş, 32 × 32 tek kanallı resim piksel değeri matrisidir;

- C1: Evrişim katmanı, toplam 6 evrişim çekirdeği, evrişim çekirdeklerinin boyutu 5 × 5, evrişim işlemi adım boyutu 1 ve 6 × 28 × 28 özellik haritaları elde edildi;

- Ö2: Havuzlama katmanı, havuzlama penceresi boyutu 2 × 2, maksimum havuzlama, 6 × 14 × 14 harita elde edildi;

- C3: Evrişimli katman, evrişim çekirdeğinin boyutu 5 × 5 ve evrişim işlemi adımı 1'dir. Kilit nokta, S2'nin 6 katmana ve C3'ün 16 katmana sahip olmasıdır Orta nasıl değiştirilir? İşte bir Yerel Olarak Bağlan yöntemi;

Birkaç örnek vermek gerekirse, C3 katmanının 0. haritası, S2 katmanının 0, 1 ve 2 haritalarını 3 filtreyle vb. Ekleyerek elde edilir.

- S4: Havuzlama katmanı, havuzlama penceresi boyutu 2 × 2, maksimum havuzlama, 16 × 5 × 5 harita elde edildi;

- C5: Evrişim katmanı, evrişim çekirdeğinin boyutu 5 × 5, evrişim işleminin adım boyutu 1 ve 1201 * 1 harita elde edildi;

- F6: Tamamen bağlantılı katman, 84 nöron.

- ÇIKTI: Çıkış katmanı nöron çekirdek işlevi (eylem işlevi), girdi bilgilerini uzamsal bir haritalamaya dönüştüren bir Gauss işlevidir ve son olarak çıktı, her bir kategorinin dağılımına aittir (toplam 10).

RBF sinir ağı ile BP sinir ağı arasındaki fark nedir?

İki, AlexNet

AlexNet, sessizlikten refaha derin öğrenmenin ortak noktasıdır. 2012 ImageNet görüntü sınıflandırma yarışmasında, AlexNet'in ilk 5 hata oranı, bir önceki yılın şampiyonuna göre yüzde on düşüşle yılın ilk yılını çok aştı. İki. Ağ yapısı şeması aşağıdaki gibidir:

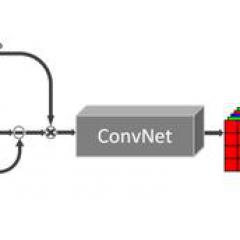

Ağ yapısının basitleştirilmiş bir versiyonu aşağıdaki gibidir:

AlexNet'in başarılı olmasının ve derin öğrenmenin tarih aşamasına geri dönebilmesinin nedeni şudur:

-

- Xiaomi yeni yılın ilk büyük etkinliğini duyurdu! Redmi yeni bağımsız bir marka oldu 48 milyon amiral gemisi burada

-

- Ma Huateng, Tencent'in büyük isimlerini Apple genel merkezine getirdi ve verdikleri hediyeler parlaktı.