Makine öğrenmiyor: Evrişimli sinir ağı NLP modellemesi ve uygulaması 2

Makine www.jqbxx.com'u öğrenmiyor: Derin toplu makine öğrenimi, derin öğrenme algoritmaları ve teknik mücadele

Önsöz: Evrişimli Sinir Ağı (Evrişimli Sinir Ağı) ilk olarak bilgisayarla görmede uygulandı ve şimdi CNN, doğal dil işlemenin (Doğal Dil İşleme) çeşitli görevlerine de uygulandı. Bu makale esas olarak CMU CS 11-747 (NLP için Sinir Ağları) kursundaki Metin için Evrişimli Ağların içeriğini açıklamak için ana satır olarak kullanır. Bu makale esas olarak aşağıdaki içerik parçalarının bir açıklamasını içermektedir: Birinci bölüm, metin temsilinde ortak dil modellerinin karşılaştığı sorunlar ve evrişimli sinir ağlarının tanıtılmasının anlamı ile ilgilidir. İkinci bölüm, evrişimli sinir ağı modülüne bir giriş niteliğindedir. Üçüncü bölüm esas olarak evrişimli sinir ağlarının doğal dil işlemede uygulanmasına ilişkin bazı makaleleri tanıtmakta ve dördüncü bölüm bu incelemeyi esas olarak özetlemektedir.

I. Örnekler

Önce böyle bir soruna bakalım, farz edelim ki cümleleri duygusal olarak sınıflandırmamız gerekiyor.

Geleneksel kelime torbası modeli veya sürekli kelime torbası modeli, tamamen bağlantılı bir sinir ağı oluşturarak cümleleri sınıflandırabilir. Bununla birlikte, bir sorun var. Bazı düğümleri etkinleştirme işlevleri aracılığıyla etkinleştirebiliriz (örneğin, bir cümle içinde "Değil", "nefret" ve diğer güçlü karakteristik kelimeler), ancak cümledeki kelimelerin sıralaması bu ağ yapısında göz ardı edildiğinden, belki de aynı iki cümle görünmez ve nefret değil, bir cümle ( Bu filmden nefret ediyorum) iyinin duygusunu ifade ediyor ve diğer cümle (bu filmden nefret ediyorum ve seçmeyeceğim) kötü duygusunu ifade ediyor. Aslında önemli bir nokta, yukarıdaki modelde nefret değil gibi birbirini izleyen iki kelimeden oluşan anahtar özelliklere sahip kelimelerin anlamını yakalayamayacağımızdır.

Dil modelinde, n-gram modeli problemi çözmek için kullanılabilir. Fikir, iki ardışık kelimeyi bir bütün olarak modele dahil etmektir. Bu gerçekten yeni ortaya çıkardığımız problemi çözebilir. Bi-gram ve tri-gram ekleyin. Örneğin "sevme" yi, "en iyiyi değil" yi yakalayalım. Ama sorun tekrar ortaya çıkıyor.Çok değişkenli bir model kullanırsak, gerçek eğitim parametreleri çok büyük bir sorundur, çünkü 20.000 kelimeniz olduğunu varsayarsak, bi-gram ekleyerek aslında 400.000.000 kelimeye sahip olacaksınız, dolayısıyla parametre eğitimi açıktır. Patlayıcıdır. Bir başka nokta da, benzer kelimelerin böyle bir modelde parametre ağırlıklarını paylaşamamasıdır, bu da benzer kelimelerin etkileşimli bilgi elde edememesine neden olacaktır.

İkincisi, evrişimli sinir ağı yapısının anlaşılması

Evrişimli sinir ağlarının kullanılması aslında yukarıdaki iki sorunu çözebilir. Evrişimli sinir ağlarından bahsetmeden önce, iki basit örneğe bakalım.

Diyelim ki soldaki kutudaki kediyi tanımladım. Aslında, kedinin bir resimdeki konumu önemli değil. Solda, sağda veya altta. Aslında kediler için özellikleri Değişmez bir şekilde, pozisyonun bu kısmında öğrenmem gereken özellikler pozisyonun başka bir kısmında da kullanılabilir, bu nedenle bu görüntüdeki tüm pozisyonlar için aynı öğrenme özelliklerini kullanabiliriz. Sağdaki örnekte, bir cümlenin kedilerle ilgili olduğunu varsayarsak, kedi kelimesinin anlamı birinci cümlede mi yoksa ikinci cümlede mi olduğuna göre değişir mi? Durumun çoğu aynı kalır, bu yüzden biz Bir metin ağı kullandığımızda, ağ her gördüğümüzde öğrenmek yerine, kedinin ne olduğunu öğrenebilir ve yeniden kullanılabilir.

Sonra, önce evrişimli sinir ağındaki her önemli bağlantıyı tanıtalım.

2.1 Evrişim

Yani burada ilk önce evrişimli sinir ağlarında evrişimin işleyişini anlıyoruz. Burada girdi olarak bir görüntü alıyoruz. Evrişimi anlamanın daha kolay yolu, evrişimi matris üzerinde hareket eden kayan bir pencere işlevi olarak düşünmektir. Aşağıdaki resimde gösterildiği gibi.

Sürgülü pencereye aynı zamanda evrişim çekirdeği, filtre veya özellik algılayıcı da denir. Şekilde, bir 3x3 evrişim çekirdeği, evrişim çekirdeğini ve matris elemanının karşılık gelen kısmını eleman ile çarpmak ve sonra toplamak için kullanılmıştır. Evrişim işlemi için aşağıdaki şeklin açıklamasına bakınız.

Evrişim çekirdeğinin ağırlığını değiştirmeden, kıvrım işlemini gerçekleştirmek için tüm görüntüyü yatay ve dikey olarak kaydırmak için bir fırça tutmak gibidir, böylece çıktı, evrişim işleminden sonra çıktı katmanı olur. İşte, anlayışınızı derinleştirebilecek evrişim işleminin animasyonlu bir gösterimi (CS231n Görsel Tanıma için Konvolüsyonel Sinir Ağları)

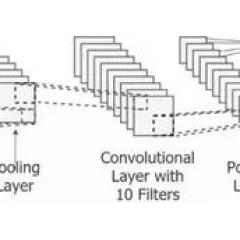

2.2 Evrişimli sinir ağı nedir

Evrişimli sinir ağı aslında çok katmanlı bir evrişim işlemidir ve daha sonra her katmanın evrişim çıktısı doğrusal olmayan bir aktivasyon fonksiyonu ile dönüştürülür (daha sonra tartışılacaktır). Evrişim sürecinde, her yerel giriş alanı bir nöron çıktısına bağlanır. Her katmana farklı evrişim çekirdekleri uygulandığında, her evrişim çekirdeği aslında resmin bir özelliğini çıkarmak ve ardından birden fazla özelliği toplamak olarak anlaşılabilir. Aşağıdaki resmi örnek olarak alın, orijinal girdi şu şekildedir: Bir resim için, ilk evrişim katmanından sonra çıktı katmanı 6 @ 28 * 28 olur, dolayısıyla buradaki evrişim çekirdeği aslında 6 evrişim çekirdeği kullanır ve 6 evrişim çekirdeği bu orijinal resmin altı farklılığını temsil eder Açı özelliği çıkarma (örneğin, resmin sol üst kısmındaki kenar çizgisini, sağ altındaki kenar çizgisini vb. Çıkarın). Özellik haritasının gerçek anlamı, özellik kanalıdır (veya bir resmin farklı özellikleri olarak anlaşılır), ki bu aynı zamanda çıktı katmanının derinliği olarak da söylenebilir, burada 6'dır ve daha sonra her bir evrişim işlemi tüm özellik kanallarını gerçekleştirmektir. Daha gelişmiş özellikler elde etmek için evrişim işlemleri gerçekleştirin. Bir sonraki bölümde açıklanacak olan havuzlama katmanı da burada yer almaktadır. Eğitim aşamasında, evrişimli sinir ağı, tamamlamak istediğiniz göreve göre evrişim çekirdeğinin ağırlık değerini otomatik olarak öğrenecektir.

Örneğin, yukarıdaki resimde, birinci katman CNN modeli, orijinal piksellerden bazı kenar çizgilerini algılamayı öğrenebilir ve ardından ikinci katmandaki bazı basit şekilleri kenar çizgilerine göre (yatay çizgiler, sola eğimli çizgiler, Dikey çizgiler, vb.) Ve ardından bu şekillere dayalı olarak bir A harfinin üst kısmı gibi daha gelişmiş özellikleri algılayın. Son katman, sınıflandırma için bu kombinasyonların üst düzey özelliklerini kullanmaktır.

Evrişimsel sinir ağındaki evrişim hesaplaması aslında şunları içerir: konum değişmezliği ve kombinasyon. Konum değişmezliği, evrişim çekirdeğinin tüm resimde çevrilmiş olmasından kaynaklanır, bu nedenle kedinin resmin neresinde olduğunu umursamanıza gerek kalmaz. Birleştirilebilirlik, her bir evrişim çekirdeğinin daha yüksek düzeyde bir özellik temsili oluşturmak için küçük bir yerel alanın düşük düzey özelliklerini birleştirmesi anlamına gelir. Elbette bu iki nokta cümle modellemesi için de çok yardımcı oluyor, aşağıdaki örneklerde bunlardan bahsedeceğiz.

2.3 Evrişim doğal dil işlemeye nasıl uygulanır?

Görüntüde, evrişim çekirdeği genellikle görüntünün küçük bir alanını hesaplar ve metinde bir cümlenin oluşturduğu kelime vektörü girdi olarak kullanılır. Her satır, bir kelimenin kelime vektörünü temsil eder, bu nedenle metin işlenirken, evrişim çekirdeği genellikle üst ve alt satırlardaki kelimeleri kapsar, bu nedenle bu sırada evrişim çekirdeğinin genişliği girişin genişliğiyle aynıdır. Birden fazla ardışık kelime arasındaki özellikler ve aynı tür özellik hesaplamasında ağırlıkları paylaşabilir. Aşağıdaki resim açıklamayı şimdi göstermektedir.

Resim, "Cümle Sınıflandırması için Evrişimli Sinir Ağlarının (ve Uygulayıcıların Kılavuzunun) Bir Duyarlılık Analizi" nden alıntılanmıştır Ye Zhang, Byron Wallace

2.4 Havuzlama katmanı

Evrişimli sinir ağlarının önemli bir kavramı, genellikle evrişimli katmanı takip eden havuzlama katmanıdır. Havuzlama katmanı, girdiyi aşağı örnekler. Havuzlama işlemi aslında her bir evrişimli katman veya her bir evrişimli katman için maksimum değeri bulmaktır. Örneğin, aşağıdaki şekil bir 2x2 pencerenin maksimum havuzlamadır (doğal dil işlemede, genellikle tüm çıktının havuzunu oluştururuz ve her evrişimli katmanın yalnızca bir çıktı değeri vardır).

Resim adresinden alınmıştır.

Neden işlemleri bir havuzda toplamamız gerekiyor?

Havuzlama, ilk olarak, doğal dil işlemede girdi cümlesinin uzunluğu üzerinde büyük bir etkiye sahip olan sabit boyutlu bir matris çıkarabilir. Örneğin, 200 evrişim çekirdeği kullanırsanız ve her çıktı için maksimum havuzlamayı kullanırsanız, o zaman evrişim çekirdeğinin boyutu ne kadar büyük olursa olsun ve giriş verilerinin boyutları veya kelime sayısı ne kadar değişirse değişsin, bir tane elde edersiniz. 200 boyutlu çıktı. Bu, farklı uzunluklardaki cümlelerle ve farklı boyutlardaki evrişim çekirdekleriyle başa çıkmanıza izin verir, ancak her zaman son sınıflandırma için aynı boyutun çıktı sonucunu alırsınız.

Ek olarak, havuz katmanı veri boyutlarını azaltırken önemli özellikleri koruyabilir. Her evrişim çekirdeği belirli bir özelliği tespit etmek için kullanılır. Cümle sınıflandırmasında, her bir evrişim çekirdeği türü, ifadelerin belirli bir anlamını tespit etmek için kullanılabilir.Bu tür bir anlama sahip kelimeler ortaya çıkarsa, evrişim çekirdeğinin çıktı değeri çok büyük olacaktır. Bu bilgiler olabildiğince saklanabilir.

Havuzlama katmanı ile ilgili çeşitli havuzlama yöntemleri aşağıdaki içerikte açıklanacaktır.

2.5 Aktivasyon fonksiyonu

Etkinleştirme işlevi hakkında birçok ayrıntı nihai özette belirtilecektir.

Üçüncüsü, evrişimli sinir ağı yapısının doğal dil işlemede uygulanması

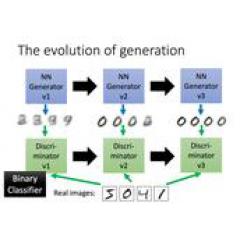

Her şeyden önce, "Doğal Dil İşleme (neredeyse) Sıfırdan" başlıklı ilk makaleyi tanıtalım. Bu makale esas olarak orijinal insan yapımı giriş özelliklerini ve yapay özellikleri hedefliyor ve daha gelişmiş metin cümlelerini otomatik olarak çıkarmak için sinir ağı yöntemlerini kullanıyor Özellikler, doğal dil işlemede çeşitli görevleri işlemek için kullanılır. Örneğin, bu makaledeki girdi bir cümle dizisidir ve çıktı, cümledeki her sözcüğün konuşma kısmının bir tahminidir. Bu makale, biri kayan pencere yaklaşımı (pencere yaklaşımı) ve diğeri girdi olarak tüm cümle (cümle yaklaşımı) olmak üzere iki yöntem önermektedir.İki yöntem sırasıyla yerel ve genel özelliklere karşılık gelir. Model yapısı aşağıdaki şekilde gösterilmektedir:

pencere yaklaşımı

cümle yaklaşımı

Pencere yaklaşımı, bir kelimeye dayalı olarak bir kelime için bir etiket ve yakındaki sabit bir uzunluk aralığı içindeki bir kelimeye karşılık gelen kelime vektörünü tahmin etmektir. Bir cümlenin başındaki veya sonundaki kelimeleri işlerken, ön ve arka camların kelime içermeyebileceğine dikkat edilmelidir.Şu anda, ön veya arka kısmı başlangıcı veya sonunu simgeleyen sembollerle doldurmak için doldurma teknolojisine ihtiyacımız var.

Aslında, pencere temelli yöntem birçok genel görevi çözebilir, ancak bir sözcük sözcüğün bağlamına çok bağlıysa ve sözcük o sırada pencerede değilse, o zaman bir cümle yaklaşımı gerekir.Burada kullanılan evrişim işlemi ve hacmi Ürün sinir ağındaki evrişim işlemi temelde aynıdır. Burada cümledeki her kelime için bir evrişim işlemi yapmak gerekir Burada, havuzlama işlemi maksimum havuzlamayı seçer.Cümledeki kelimelerin çoğunun kelimenin anlamını etkilemeyeceğine inanılmaktadır.

Makale şimdi, doğrudan havuz katmanında maksimum havuzlamayı seçti. Bir sonraki makale "Cümleleri Modellemek için Evrişimli Bir Sinir Ağı" cümle düzeyinde özelliklerin ve önerilen DCNN dinamiklerinin havuzlama sürecini geliştirdi. Evrişimli ağ (Dinamik Evrişimli Sinir Ağı), makaleyi tanıtmadan önce, ilk olarak birkaç ortak havuzlama yöntemini tanıtın.

Maksimum havuzlama en yaygın olanıdır.Maksimum havuzlama, tüm bölgenin maksimum değerini bir özellik olarak almaktır.Genel olarak doğal dil işlemede sınıflandırma problemlerinde kullanılır.Gözlenen özelliğin hangi kategoriden ayırt edilebilmesi için güçlü bir özellik olması umulmaktadır. Ortalama havuzlama genellikle konu modelleri için kullanılır. Genellikle birden fazla konu etiketi içeren bir cümledir. Maksimum havuz kullanılırsa, çok az bilgi vardır, bu nedenle Ortalama kullanımı bu alanın özelliklerini geniş bir şekilde yansıtabilir. Son iki K-max havuzu, bir bölgenin ilk k büyük özelliğini seçmektir. Dinamik havuzlama, ağ yapısına göre özelliklerin sayısını dinamik olarak ayarlamaktır. Son ikisinin birleşimi, kağıdın en önemli özelliği.

Makalenin en önemli özelliği, önce cümlenin anlamını modellemektir. Alt katmanda, bitişik kelimelerin bilgileri kademeli olarak yukarı doğru iletilmek üzere birleştirilir ve üst katman, yeni anlamsal bilgileri birleştirir, böylece cümledeki kelimelerin etkileşimli davranışları (veya bir tür Anlamsal bağlantı). Sezgisel bir bakış açısıyla, bu model, kelimelerin kombinasyonu ve ardından havuzlama katmanı yoluyla cümlelerde önemli anlamsal bilgileri çıkarabilir.

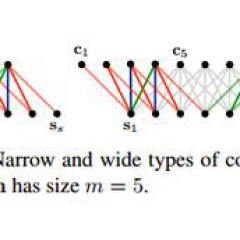

Diğer bir parlak nokta ise, havuzlama sürecinde modelin dinamik k-Max havuzlaması kullanmasıdır.Buradaki havuzlamanın sonucu maksimum değer döndürmek değil, maksimum değerlerin k grubu döndürmektir.Bu maksimum değerler, orijinal girdinin bir alt dizisidir. Havuzlamadaki k parametresi dinamik bir işlev olabilir ve belirli değer ağın girişine veya diğer parametrelerine bağlıdır. Bu modelin ağ yapısı aşağıdaki şekilde gösterilmektedir:

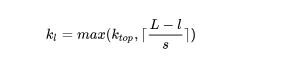

Burada k-max havuzlamaya ve dinamik k-max havuzlamaya odaklanıyoruz. K-max'ın avantajı, sıralarını korurken cümledeki birden fazla önemli bilgiyi çıkarmasıdır. Aynı zamanda, buradaki k sayısı dinamik olarak değiştirilir ve spesifik dinamik fonksiyon aşağıdaki gibidir.

Burada, s'nin cümlenin uzunluğunu, L'nin toplam evrişimli katman sayısını ve l'nin mevcut evrişimli katman sayısını temsil ettiğine dikkat edilmelidir, bu nedenle burada K'nin cümlenin uzunluğunu takip ettiği ve Ağın derinliği değişir ve sezgisel deneyimimiz, ilk cümle katmanının daha fazla özellik çıkardığını ve daha sonra çıkarılan özelliklerin kademeli olarak azalacağını da görebilir. Aynı zamanda Ktop, çıkarılması gereken en üst evrişimli katmanı temsil eder. numara.

Buradaki ağ yapısı çoğunlukla olağan evrişimli ağ katmanı ile aynıdır, ancak bir Katlama katmanı (katlama işlemi katmanı) olduğu unutulmamalıdır. İki bitişik sıra arasında belirli bir bağlantı düşünün ve iki sıranın kelime vektörlerini ekleyin.

Model, aşağıdaki gibi özetlenen birçok vurguya sahiptir: Birincisi, cümle içindeki kelime sırasının ve kelimelerin göreceli konumunu korur ve aynı zamanda cümle içinde birbirinden çok uzak olan kelimeler arasındaki anlamsal bilgileri dikkate alır ve dinamik k-max havuzlaması ile cümleyi daha iyi korur. Dinamik olarak cümle uzunluğuna göre birden çok önemli bilgiden çıkarılan özelliklerin sayısı.

Kağıt şimdi havuzlama sürecini iyileştiriyor ve sonraki iki makale evrişimli katmanı geliştiriyor. Üçüncü makale, makine çevirisi alanında Dilate Evrişim uygulamasını öneren "Doğrusal Zamanda Nöral Makine Çevirisi" dir. Dilate evrişimin gerçekten çözdüğü sorun, havuzlama katmanının havuzlanmasının birçok bilgiyi kaybetmesidir (bilginin yararlı veya yararsız olmasına bakılmaksızın). Dilate evrişimin ana katkısı, ağın alıcı alanını azaltmadan havuzlama işleminin nasıl kaldırılacağıdır. Aşağıdaki şeklin anlaşılması daha kolaydır: Evrişimin giriş piksel aralığı 1-2-4-8'dir Havuzlama katmanı olmamasına rağmen, katmanın derinliği tarafından kapsanan orijinal girdi bilgisi hala artmaktadır. Yani, genellikle evrişim çekirdeğinin boyutsallığını ve giriş alanını aynı tutuyoruz, ancak havuzlama katmanını kaldırdıktan sonra, derinlik arttıkça, evrişim çekirdeğinin kaplayabileceği girdi alanı ikiye katlanır.

Bu modelde, cümle modellemesinin girişi cümlenin karakter seviyesi ile başlar ve daha sonra evrişim çekirdeği tarafından kapsanan aralık genişledikçe, orijinal girdi bilgisinin kaybolmaması sağlanırken bilgi sürekli değiş tokuş edilir.

Önceki makaleler esas olarak evrişim katmanını ve havuz katmanını kendi yapısından değiştirmiştir.Aşağıdaki makale esas olarak cümlenin kendisinin mevcut bağımlılık sözdizimi ağacı bilgilerini dikkate almakta ve cümle modellemesine entegre etmektedir. "Cümle Gömme için Bağımlılık Temelli Evrişimli Sinir Ağları" makalesi bu fikri ortaya koymaktır.Modelin amacı, sadece cümledeki bitişik kelime bilgisini özellik bilgisi olarak kullanmak değildir, bağımlı bir sözdizimi ağacı aslında cümlenin anlamını alır Bilgi ilişkisi gerçekten çıkarılmıştır.Tüm evrişim süreci nedeniyle cümlenin kelime sırası ilişkisi kaybolacaktır.Bağımlılık sözdizimi ağacındaki ebeveyn-çocuk düğümlerinin kelime sırası bilgileri ve girdi olarak kardeş kelime sırası bilgileri alınarak cümlenin özellikleri daha etkin bir şekilde çıkarılabilir.

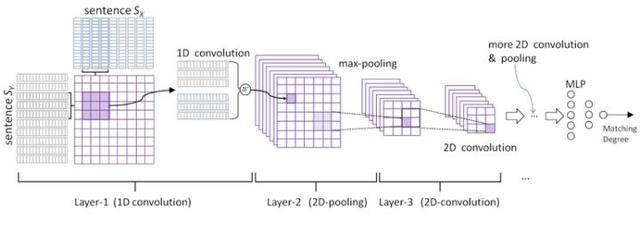

Sunulacak son makale cümle eşleştirme (Cümle Eşleştirme) hakkındadır, temel sorun hala cümle modellemedir. Her şeyden önce makalede CNN tabanlı bir cümle modelleme ağı önerilmiştir Evrişimin işlevi cümlelerden yerel anlamsal kombinasyon bilgisini çıkarmaktır ve çoklu Özellik Haritaları, çıkarımı sağlamak için birden çok açıdan çıkarılır. Anlamsal kombinasyonların çeşitliliği. Aynı ve sabit uzunlukta iki vektör elde etmek için iki cümleyi ayrı ayrı modelleyin (yukarıdaki cümle modelini kullanarak) ve sonra bu iki vektörü çok katmanlı bir algılayıcı (MLP) girdisi olarak kullanın ve son olarak Maçın skorunu hesaplayın.

Bu model nispeten basittir, ancak büyük bir dezavantajı vardır. İki cümle, herhangi bir etkileşim olmaksızın, modelleme sürecinde tamamen bağımsızdır. Etkileşim, soyut vektör temsili nihai olarak oluşturulana kadar gerçekleşmeyecektir. Soyut modelleme sürecinde birçok anlamsal detay kaybolmakta, bu nedenle ikinci model yapısı tanıtılmaktadır.

Bu yapı, iki cümle arasındaki etkileşimi ilerletir. İlk katmanda, önce sabit bir evrişim penceresi K1'i alın ve ardından Sx ve Sy'deki tüm birleşik iki boyutlu matrisleri evrişim için çaprazlayın ve her iki boyutlu matris çıktıları Bir değer Katman-2'yi oluşturur ve ardından 2 × 2 Maks-havuzlama gerçekleştirir Sonraki evrişim katmanlarının tümü geleneksel iki boyutlu evrişim işlemleridir.

Dört, özet / QA

Bu inceleme, özellikle evrişimli sinir ağlarının yapısını ve doğal dil işlemede uygulanan sahneleri tanıtıyor ve son olarak kısa bir özet yapıyor.

Ayrıca sizinle paylaşmak için evrişimli sinir ağlarının detayları hakkında bazı sorular ve cevaplar var.

1. Evrişimli katman ile havuz katmanı arasındaki fark nedir?

Öncelikle, konvolüsyondan sonra çıktı katmanının boyutluluğunun azaldığı ve derinliğin derinleştiği yapıdan görülebilmektedir. Ancak havuz katmanının derinliği değişmeden kalır. Aynı zamanda, havuzlama, çok sayıda veriyi maksimum veya ortalama değerlerle değiştirebilir. Amaç, veri miktarını azaltmaktır. Eğitim parametrelerini azaltın. Giriş katmanı için, pikseller mahallede biraz yer değiştirdiğinde, havuzlama katmanının çıktısı değişmez ve bu da sağlamlığı artırabilir. Evrişim, sonraki ayırmayı kolaylaştırmak için bir evrişim çekirdeği aracılığıyla verileri özelliklere dönüştürmektir.

2. Geniş evrişimi kullanmanın faydaları nelerdir?

Giriş köşesinin değerini kayan pencerenin ortasına dahil ederek hesaplayın, böylece daha az bilgi kaybolur.

3. Evrişim çıktısının derinliği, parça sayısıyla aynı mı?

Çıktı derinliği (kanal), evrişim çekirdeklerinin (filtrelerin) sayısına eşittir.

4. Aktivasyon işlevi genellikle evrişimli sinir ağının hangi işleminden sonra yerleştirilir?

Genellikle kıvrımlı katmandan sonra yerleştirilir.

5. Etkinleştirme işlevi neden genellikle doğrusal olmayan bir işlevdir?

Ağda doğrusal işlevlerin bir kombinasyonu kullanılıyorsa, doğrusal kombinasyon hala doğrusaldır, bu nedenle birden çok doğrusal kombinasyon kullanmak, doğrusal bir işlevi kullanmaya eşdeğerdir. Bu nedenle, herhangi bir fonksiyon doğrusal olmayan fonksiyonla yaklaşık olarak tahmin edilebilir.

6. Doğrusal olmayan aktivasyon fonksiyonundaki sigmod fonksiyonunun dezavantajları nelerdir?

Sigmod fonksiyonu, özellikle değer çok büyük olduğunda doymuş bir duruma sahiptir.Doygun duruma girerken, gradyan iniş hesaplaması yapılırken, gradyanın kaybolması kolaydır ve türevin doğru değeri garanti edilemez.

7. ReLU ve SoftPlus aktivasyon fonksiyonlarının avantajları nelerdir?

Sigmod ile karşılaştırıldığında üstel bir hesaplama yoktur ve türetme için hesaplama miktarı azaltılır ve aynı zamanda aşırı uydurma durumu hafifletilir Çıktının bir kısmı 0'dır, bu da parametrelerin birbirine bağımlılığını azaltır.

Transfer adresi: https://zhuanlan.zhihu.com/p/30268946

-

- Geçiştirmek? Ortalıkta dolanmak? Ayrık grafik kartına gerek yok APU daha uygundur, 2400 yuan yapılandırma ekranı