Derin Evrişimli Çekişmeli Üretim Ağı (DCGAN)

Evrişimli sinir ağları, denetimli öğrenmede çeşitli görevlerde iyi performansa sahiptir, ancak denetimsiz öğrenme alanında nispeten nadirdirler. Bu makalede tanıtılan algoritma, CNN'yi denetimli öğrenmede ve GAN'ı denetimsiz öğrenmede birleştirir.

CNN dışı koşullar altında, LAPGAN, görüntü çözünürlüğü geliştirme alanında da iyi sonuçlar elde etti.

Bu makaleyi CNN'in bir uzantısı olarak görmek yerine, GAN'ın CNN alanına bir uzantısı olarak görmek daha iyidir. GAN'ın temel algoritması, düşman sinir ağına başvurabilirsiniz.

GAN, belirli bir maliyet fonksiyonunun ve öğrenme sürecinin avantajları olmadan iyi bir özellik temsilini öğrenebilir, ancak GAN eğitimi çok istikrarsızdır ve genellikle jeneratörün anlamsız çıktı üretmesine neden olur. Tezin katkısı şu şekildedir:

-

CNN'in ağ topolojisini eğitimde kararlı hale getirmek için bir dizi kısıtlama getirilmiştir.

-

Görüntü sınıflandırması yapmak için elde edilen özellik temsilini kullanın ve oluşturulan görüntü özelliği temsilinin ifade yeteneğini doğrulamak için daha iyi sonuçlar elde edin

-

GAN tarafından öğrenilen filtre, niteliksel olarak analiz edilir.

-

Oluşturulan unsur temsilinin vektör hesaplama özelliklerini gösterir.

Model yapısı

Model yapısında aşağıdaki değişikliklerin yapılması gerekir:

-

Ayırıcıda adımlı konvolüsyonların kullanıldığı ve jeneratörde kesirli adımlı konvolüsyonların kullanıldığı havuz katmanı konvolüsyonlarını değiştirin.

-

Hem jeneratör hem de ayırıcıda batchnorm kullanın.

-

Zayıf başlatma sorununu çözün

-

Degradenin her katmana yayılmasına yardımcı olun

-

Jeneratörün tüm numuneleri aynı noktaya yaklaştırmasını önleyin.

-

BN'nin doğrudan tüm katmanlara uygulanması, örnek salınımlarına ve model kararsızlığına neden olacaktır.Bu fenomen, jeneratör çıkış katmanında ve ayırıcı giriş katmanında BN kullanılmayarak önlenebilir.

-

Tamamen bağlı katmanı kaldırın

-

Küresel havuzlama, modelin kararlılığını artırır, ancak yakınsama hızına zarar verir.

-

ReLU, çıkış katmanı hariç jeneratörün tüm katmanlarında, çıkış katmanında ise tanh kullanılır.

-

LeakyReLU diskriminatörün tüm katmanlarında kullanın.

DCGAN'ın jeneratör ağ yapısı:

Bunların arasında, buradaki konv katmanı, diğer kağıtlarda ters evrişim olarak da adlandırılabilecek dört fraksiyonel-adımlı evrişimdir.

Eğitim ayrıntıları

-

Ön işleme adımında, görüntü tanh olarak ölçeklenir.

-

Mini toplu eğitim, parti boyutu 128'dir.

-

Tüm parametreler (0, 0,02) normal dağılımından başlatılır ve sonra elde edilir

-

LeakyReLU'nun eğimi 0,2'dir.

-

Önceki GAN eğitimi hızlandırmak için momentum kullansa da DCGAN, Adam optimizer'ı ayarlanmış süper parametrelerle kullanıyor.

-

öğrenme oranı = 0.0002

-

Salınım ve kararsızlığı önlemek için momentum parametresi beta'yı 0,9'dan 0,5'e düşürün.

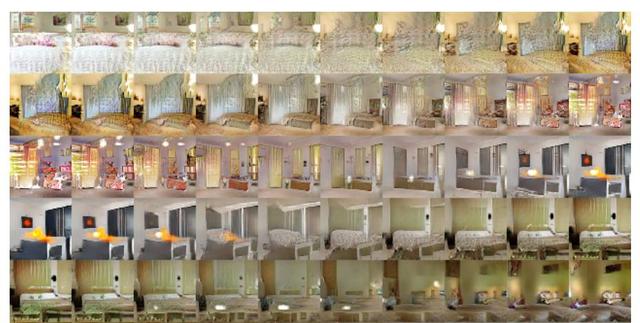

LSUN görüntülemeleri

Bir eğitim (çevrimiçi öğrenme) ve yakınsama döngüsünden sonra, modelin etkileri aşağıdaki gibidir:

Bu, DCGAN'ın eğitim verilerini ezberleyerek yüksek kaliteli resimler oluşturmadığını / bunlara uymadığını gösterir.

DCGAN yetenekleri doğrulaması

DCGAN'ın özellik sunumunun etkinliğini doğrulamak için, özellik gösterimi L2-SVM'ye girilir ve sınıflandırma sonucu diğer denetimsiz öğrenme algoritmalarıyla karşılaştırılır.

Bunu yapmak için, ImageNet-1K üzerinde eğitilmiş oluşturucuyu kullanın, tüm katmanların tüm CNN özelliklerini girdi olarak kullanın, max-pooling kullanarak her katmanın CNN özelliklerini 4 × 4'e düşürün ve sonra forma genişletin. 28672 boyutlu bir vektör, L2-SVM'ye girilir.

Mnist veri seti üzerindeki etkilerin karşılaştırılması:

SVNH veri kümesinde karşılaştırma:

Gizli alanda gezinme

Gizli alanın son görüntünün oluşumunu nasıl etkilediğini keşfetmek için ilk vektörü yavaşça ayarlayın. Bu şekilde, yalnızca görüntü özelliklerinin gizli alana nasıl katlandığını keşfetmekle kalmaz, aynı zamanda bu görüntülerin anlamsal özellikleri gerçekten öğrenip öğrenmediğini veya sadece görüntüyü hatırlayıp hatırlamadığını (keskin bir değişiklik varsa) tespit edebilirsiniz.

Yukarıdaki resimden bazı kademeli değişiklikler görebilirsiniz, örneğin altıncı sırada kademeli olarak bir pencere var. Dördüncü sırada, TV yavaş yavaş kaybolur.

Ayırıcı Filtre

Filtreyi analiz ederek, ev özelliklerinin öğrenilmesinde GAN'ın gerçekten de yataklar ve pencereler gibi özellikleri öğrendiğini görebiliriz.

Solda rastgele bir filtre ve sağda öğrenilmiş bir filtre var Sağdaki filtrenin hala anlamlı olduğu görülüyor.

Anlamsal Maske

Gizli alanda, hangi değişkenlerin bir nesneyi kontrol ettiğini bildiğinizi varsayarsak, bu değişkenleri engelleyerek oluşturulan resimdeki bir nesneyi ortadan kaldırabilir misiniz?

Makaledeki deney şu şekildedir: İlk olarak, pencereler dahil olmak üzere penceresiz 150 resim üretin ve ardından bunları sınıflandırmak için bir lojistik regresyon fonksiyonu kullanın.Sıfır olmayan ağırlığa sahip özellikler için, bunun pencerelerle ilgili olduğunu düşünün. Yeni oluşturulmuş bir resim almak için onu engelleyin.

Vektör Aritmetik

Word2vec'e benzer şekilde, görüntünün benzer özellikleri var mı ve yeni bir görüntü elde etmek için gizli alana ekleme ve çıkarma yapabilir mi?

Deneyler, tek bir resim kullanan temsilin sabit olmadığını ve üç resmin kullanımının daha kararlı olacağını göstermiştir.

Tek bir resmin sabit olmadığı görülürken, üç resmin ifadeler ve güneş gözlüğü gibi özellikleri öğrenebildiği görülmektedir.

Dahası, yönelim dönüşümü gibi belirli dönüşümleri gerçekleştirmek için kararlı bir vektör öğrenebilirsiniz.

sonuç olarak

Bu makalenin ana katkısı basit görünebilir, ancak aslında çok fazla çalışma gerektiriyor ve yazarın Dafa'yı ayarlamadaki üstün becerilerini tam olarak gösteriyor.

Ancak bence daha büyük katkı, yazarın etkilerle ilgili araştırmasında yatıyor. Üretken modeller için iyiyi kötüden ayırt etmek zordur. Bu makale, DCGAN algoritmasını gizli alanı keşfetmek, ağı analiz etmek ve özellik performansını karşılaştırmak gibi bir dizi yöntemle kanıtlamaktadır. Gerçekten de güçlü bir algoritmadır.

-

- Kahire'nin "Ölüm Şehri" nde mimarlar, mülteciler için sığınaklar inşa etmek için konteynerler kullandılar.

-

- Harvard'ın yeni H6 Coupe kırmızı standart versiyonu elektronik vites kolu / gücü olan casus fotoğrafları değişmeden kalıyor

-

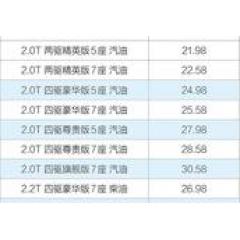

- Ssangyong Yeni Lexton G4 resmi olarak piyasaya sürüldü, fiyatı 219.800-31.800 yuan / 10 model olarak piyasaya sürüldü

-

- Beatles, 8 şehri birbirine bağlamak için "Bumblebee" ile el ele verir, "solucanlar" kalplerini yakar