Facebook açık kaynak NLP geçiş öğrenme araç seti, 93 dili destekler, en iyi performans

Xin Zhiyuan Rehberi Facebook bugün, 93 dili destekleyen ve 28 farklı alfabe ile yazılan NLP araç kiti LAZER'in gelişmiş bir sürümünü açık kaynaklı hale getirdi. Bu, büyük çok dilli cümle temsillerini başarıyla araştıran ilk açık kaynaklı NLP aracı oldu.

Facebook bugün NLP araç setinin genişletildiğini ve geliştirildiğini duyurdu LAZER (Dilden bağımsız SEntence Temsilleri) Ve açık kaynak kodlu.

LAZER, büyük çok dilli cümlelerin temsilini başarıyla araştıran ilk açık kaynaklı NLP aracı oldu. Araç seti artık 90'dan fazla dili desteklemektedir ve 28 farklı alfabede yazılmıştır. LASER, tüm dilleri paylaşılan bir alana yerleştirerek (her dili ayrı ayrı modellemek yerine) bu sonuçlara ulaşır.

Facebook ayrıca ücretsiz sağlar Çok dilli kodlayıcı ve PyTorch kodu Ve 100'den fazla dil içeren çok dilli bir test seti.

Açık kaynak adresi:

https://github.com/facebookresearch/LASER

LAZER, bir dilden (İngilizce gibi) diğer dillere (son derece sınırlı eğitim verisi olan diller dahil) NLP modellerini açar Sıfır atış transferi Kapı açıldı. LAZER Tek bir model kullanarak birden çok dili işleyen ilk kitaplık , Düşük kaynak dilleri (Kabyle ve Uygur gibi) ve lehçeler (Wu dili gibi) dahil.

Gelecekte bu çalışma, Facebook ve diğer şirketlerin, film incelemelerini tek bir dilde olumlu veya olumsuz olarak sınıflandırmak ve ardından bunları 100'den fazla başka dilde yayınlamak gibi bazı belirli NLP özelliklerini başlatmasına yardımcı olabilir.

Performans ve öne çıkan özellikler

LAZER, XNLI Corpus olacak 13/14 dil nın-nin Sıfır örneklemli diller arası doğal dil muhakemesi Doğruluk, yeni en yüksek seviyeye yükseltildi. Hala içinde Çapraz metin belge sınıflandırması (MLDoc Corpus) güçlü sonuçlar almak için. Cümleniz gömülüdür Paralel Corpus Madenciliği Bu özellik aynı zamanda çok güçlüdür ve BUCC paylaşılan görevindeki dört dil çiftinden üçü için yeni optimal sonuçlar sağlar (BUCC, karşılaştırılabilir kurumların oluşturulması ve kullanılması üzerine bir 2018 semineridir).

LASER araç setine ek olarak, Tatoeba külliyatına dayalı olarak da paylaştık. 100'den fazla dilde hizalı cümle testi seti içerir . Bu veri setini kullanarak, cümle yerleştirmelerimiz, kaynakları düşük dillerde bile çok dilli benzerlik arama görevlerinde güçlü sonuçlar elde etti.

LAZER ayrıca başka avantajlar da sağlar:

- Çok hızlı performans sağlar ve GPU'da saniyede 2000 cümleye kadar işleyebilir.

- Cümle kodlayıcı, minimum dış bağımlılıkla PyTorch kullanılarak uygulanır.

- Düşük kaynak dilleri, birden çok dilde ortak eğitimden yararlanabilir.

- Model, bir cümlede birden çok dilin kullanılmasını destekler.

- Daha fazla yeni dil eklendikçe, sistem dil ailesinin özelliklerini tanımayı öğrenecek ve performansı artacaktır.

Genel dilden bağımsız cümle yerleştirme

LASER'in cümle vektör gösterimi hem giriş dili hem de NLP görevleri içindir Evrensel nın-nin. Bu araç, herhangi bir dildeki bir cümleyi yüksek boyutlu bir uzaydaki bir noktaya eşler.Amaç, herhangi bir dilde aynı cümlenin nihayetinde aynı alanda yer almasını sağlamaktır. Bu temsil, anlamsal vektör uzayında evrensel bir dil olarak kabul edilebilir. Uzaydaki mesafenin cümlenin anlamsal sıkılığı ile yakından ilişkili olduğunu gözlemledik.

Yöntemimiz, nöral makine çevirisi ile aynı temel teknolojiye dayanmaktadır: sıradan diziye işleme olarak da bilinen kodlayıcı / kod çözücü yöntemi. Tüm giriş dilleri için paylaşılan bir kodlayıcı ve çıktı dilleri oluşturmak için paylaşılan bir kod çözücü kullanıyoruz. Kodlayıcı, 5 katmanlı çift yönlü bir LSTM ağıdır. Nöral makine çevirisinden farklı olarak, dikkat mekanizması kullanmıyoruz, ancak girdi cümlesini temsil etmek için 1024 boyutlu sabit boyutlu vektörler kullanıyoruz. BiLSTM'nin son durumunun maksimum havuzlanmasıyla elde edilir. Bu, cümlelerin temsillerini karşılaştırmamıza ve bunları doğrudan sınıflandırıcıya beslememize olanak tanır.

Yaklaşımımızın mimarisi

Bu cümle yerleştirmeleri, doğrusal dönüşüm yoluyla kod çözücü LSTM'yi başlatmak ve her zaman adımında giriş gömme işlemine bağlamak için kullanılır. Kodlayıcı ile kod çözücü arasında başka bir bağlantı yoktur, çünkü girdi dizisinin tüm ilgili bilgilerinin cümle yerleştirme ile yakalanmasını istiyoruz.

Kod çözücü, hangi dilin üretilmesi gerektiğini bilmelidir. Her zaman adımında girdi ve cümle yerleştirmeye bağlanan bir dil kimliği yerleştirme kullanır. Tüm eğitim kurumlarının bağlantılarını eğitmek için 50000 işlem içeren ortak bir bayt çifti kodlama (BPE) sözlüğü kullanıyoruz. Kodlayıcı, giriş dilini gösteren açık bir sinyale sahip olmadığından, bu yöntem Kodlayıcıları dilden bağımsız temsilleri öğrenmeye teşvik edin .

Sistemi 223 milyon cümle genel paralel veriye dayalı olarak eğitiyoruz (cümleler İngilizce veya İspanyolca ile uyumludur). Her bir mini grup için rastgele bir giriş dili seçer ve sistemi cümleleri İngilizce veya İspanyolcaya çevirmesi için eğitiriz. Çoğu dil bu iki hedef dil ile uyumludur, ancak bu gerekli değildir.

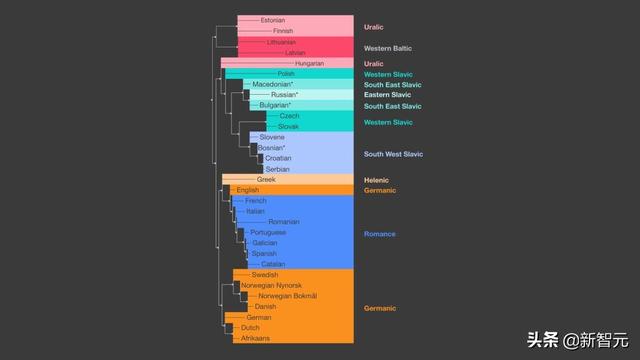

Bu çalışmanın başında, hepsi aynı Latin alfabe sistemini kullanan 10'dan az Avrupa dilini eğittik. Daha sonra, Europarl külliyatında verilen 21 dile kademeli olarak yükseldik ve sonuçlar, dillerin artmasıyla çok dilli göç performansının da iyileştiğini gösterdi. Sistem dil ailelerini öğrendi (dil aileleri) Genel özellikleri . Böylece, Düşük kaynaklı diller, aynı dil ailesinin yüksek kaynak dillerinin kaynaklarından yararlanabilir .

Bu, tüm dillerdeki bağlantılar konusunda eğitilmiş paylaşılan bir BPE sözlüğü kullanılarak sağlanabilir. Her dilin BPE kelime dağarcığının dağılımı arasındaki Kullback-Leiber mesafesi üzerinde simetrik bir küme analizi yaptık ve sonuçlar Kullback-Leiber mesafesinin dilbilimde tanımlanan dil ailesiyle neredeyse tamamen ilişkili olduğunu gösterdi.

Ardından, paylaşılan bir BiLSTM kodlayıcının birden fazla komut dosyasını işleyebileceğini fark ettik ve kademeli olarak mevcut paralel metinle tüm dillere genişlettik. LAZER dahil 93 dil Özne-yüklem-nesne (SVO) sırası (İngilizce gibi), özne-nesne-yüklem (SOV) dilleri (Bengalce ve Türkçe gibi) ve yüklem-özne-nesne (VSO) dillerini (örneğin Tagalog ve Berber) ve hatta yüklem-özne-nesne (VOS) sırasına göre diller (Malgaşça gibi).

Kodlayıcımız, eğitim sırasında kullanılmayan dillere (tek dilli metinler bile) genelleştirilebilir. Asturian, Faroe, Frizce, Kashubian, Northern Moluccan, Piedmontese, Swabian gibi bazı bölgesel dillerde iyi performans gösterdiğini tespit ettik. Ve Sorbian. Tüm bu diller, diğer ana dillerle değişen derecelerde bazı benzerliklere sahiptir, ancak dilbilgisi veya belirli sözcük dağarcığı farklıdır.

Bu tablo, XNLI külliyatında LASER'in sıfır vuruşlu geçiş performansını göstermektedir (Conneau ve diğerleri, Çapraz Dilde Cümle Temsillerini Değerlendirme, EMNLP'18). BERT'in sonuçları GitHub README'den gelmektedir. (Not: Bu sonuçlar, bu makalede PyTorch 0.4 kullanılarak elde edilen sonuçlardan biraz farklı olan PyTorch 1.0 kullanılarak elde edilmiştir.)

Sıfır örnek, diller arası doğal dil muhakemesi

Bizim modelimiz Çapraz dilli doğal dil muhakemesi (diller arası doğal dil çıkarımı, NLI) iyi sonuçlar elde etti. Bu görevdeki performans güçlü bir göstergedir, modelin bir cümlenin anlamını nasıl ifade ettiğini iyi bir şekilde gösterebilir. Düşündük sıfır atış ayarları Başka bir deyişle, NLI sınıflandırıcısını İngilizce için eğitmek ve ardından ince ayar yapmadan veya hedef dil kaynaklarını kullanmadan bunu tüm hedef dillere uygulamaktır.

14 dil arasında 8 dilin sıfır atış performansı, Rusça, Çince ve Vietnamca dahil olmak üzere İngilizce'nin performansına kıyasla% 5'i geçmiyor. Svahili ve Urduca gibi düşük kaynak dillerinde de iyi sonuçlar elde ettik. Son olarak, LASER tarafından test edilen 14 dilde, 13 dil, önceki tüm zero-shot transfer yöntemlerinden daha iyi performans gösterdi.

Sistemimiz tamamen çok dillidir ve farklı dillerdeki herhangi bir öncül ve varsayım kombinasyonunu destekler Bu, İngilizce bir cümle gerektiren önceki yöntemden farklıdır.

Aynı cümle kodlayıcı, çok sayıda tek dilli metinde paralel veri madenciliği yapmak için de kullanılır. Sadece tüm cümle çiftleri arasındaki mesafeyi hesaplamamız ve en yakın cümle çiftini seçmemiz gerekiyor. Bu yöntem, en yakın cümle ile diğer en yakın cümleler arasındaki mesafe dikkate alınarak daha da geliştirilmiştir. Bu arama, Facebook'un FAISS kitaplığı kullanılarak verimli bir şekilde gerçekleştirildi.

Paylaşılan BUCC görevlerindeki performansımız Mevcut sanatın çok ötesinde . Optimal sistem, bu görev için özel olarak geliştirilmiştir. F1 puanını Almanca / İngilizce için 85,5'ten 96,2'ye, Fransızca / İngilizce 81,5'ten 93,9'a, Rusça / İngilizce için 81,3'ten 93,3'e ve Çince / İngilizce için 77,5'ten 92,3'e yükselttik. Tüm bu örnekler, sonuçlarımızın tüm dillerde oldukça homojen olduğunu göstermektedir.

Bu yöntemin ayrıntılı bir açıklaması, Mikel Artetxe ile birlikte yazılan Zero-Shot Çapraz Dil Transferi ve Ötesi için Çok Dilli Cümle Gömme araştırma makalesinde okunabilir.

Adres: https://arxiv.org/abs/1812.10464

Herhangi bir dil çiftini kullanarak, 90'dan fazla dilde paralel veri madenciliği yapmak için aynı yöntem kullanılabilir. Bu, düşük kaynak dilleri için nöral makine çevirisi dahil olmak üzere paralel eğitim verilerine dayanan birçok NLP uygulamasını önemli ölçüde iyileştirecektir.

Gelecek uygulamalar

LASER kitaplığı, diğer ilgili görevler için de kullanılabilir. Örneğin, çok dilli anlamsal alanın özellikleri, cümleleri yorumlamak veya benzer anlamlara sahip cümleleri aramak için kullanılabilir - aynı dil kullanılabilir veya LASER tarafından şu anda desteklenen 93 dilden herhangi biri kullanılabilir. Modeli geliştirmeye ve mevcut 93 dile daha fazla dil eklemeye devam edeceğiz.

-

- Kızı sokakta bıçakla kaçıran adam 100,000 yuan'e şantaj yapmak istedi ve polis şefi onu bastırmak için bıçağı çıplak elleriyle tuttu!

-

- Oyunun başlatıldığı gün sunucu kilitlendi ve şirket iflas etti, ancak ilgili kişi geldi ve benimle hiçbir ilgisi olmadığını söyledi?

-

- Pekin Otomobil Fuarı'nda çeşitli SUV'ler göründü, Chery Holding Jietu bir "seyahat +" ekolojik ittifak yaratmayı planlıyor

-

- Çin Masa Tenisi Şampiyonasının ilk gününün özeti: Tek erkekler Zhang Jike'tan üç yeni yıldız, tek bayanlar 4'ün tümü geçecek

-

- Liang Zhenying'in bir sonraki genel yönetici seçimini terk etmesi, Hong Kong hisselerindeki düşüşü daraltıyor ve genel müdürlerin konsept hisse senetleri yükseliyor