Sahne sapmasını azaltmak için eylemlerin ve sahnelerin sıkı sıkıya bağlanması gerekmez ve dans eden alışveriş merkezlerini kolayca tanımlayabilir

Yazar | Jiang Weiwei

Editör | Jia Wei

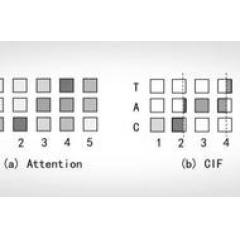

Son birkaç yılda, Convolutional Neural Networks (CNN), videolarda eylem tanıma sorununda büyük ilerleme kaydetti. Bununla birlikte, bu yöntemler arka plandaki sahneye çok fazla odaklanma ve belirli eylemin kendisini görmezden gelme eğilimindedir. Şekil 1'de gösterildiği gibi, resimde insan eylemleri engellenmiş olsa da, yine de sahneden en olası eylem türünü çıkarabiliriz. Evrişimli sinir ağı modeli için, sahneyi tanımlayarak verilen eylem türü kaçınılmaz olarak sahne sapmasına yol açacaktır.

Şekil 1. İnsanları göremesek de, olay yerinden belirli eylemler çıkarabiliriz.

Bu tür bir sahne sapması, modelin bazı durumlarda görmek istemediğimiz etkiler üretmesine neden olabilir. Şekil 2'de görüldüğü gibi soldaki resimde beyzbol sahasının arka planından dolayı şarkı söyleyen kişinin yanlışlıkla beyzbol oynadığı tahmin edilecektir.Sağdaki resimde yüzen kişiyi tamamen bloke etsek bile model olacaktır. Arka planın tanınması, yüzmenin tahmin edilen sonucu verilir.

Şekil 2. Alçaltma algoritmaları üzerine araştırma için motivasyon.

Sahne önyargısını ortadan kaldırmaya yönelik nispeten az sayıda araştırma vardır. NeurIPS 2019'da yayınlanan aşağıdaki makale, sahne önyargısını azaltmak için geçiş öğrenmeye dayalı bir çözüm önermektedir.

Makaleye bağlantı: https://arxiv.org/pdf/1912.05534.pdf

Bu makalenin katkısı, CNN modellerini önceden eğitirken sahne önyargısını azaltmak için tasarlanmış iki kayıp tanımı önermektir:

1) Modeli, sahnenin özellik temsilini değişmeden öğrenmeye teşvik eden sahne çekişme kaybı (sahne çekişme kaybı);

2) Modelin insan vücudu görünmediğinde hala eylem tahminleri vermesini önlemek için insan maskesi kafa karışıklığı kaybı.

Önerilen şemanın etkinliğini doğrulamak için, bu makale üç eylem anlama görevi üzerinde deneyler yürütmüştür: eylem sınıflandırması, zamansal eylem konumu ve uzaysal zamansal eylem tanıma. Deneysel sonuçlar, önyargı kaldırmayı kullanan geçiş öğrenme şemasının karşılaştırma modelinden daha iyi performans gösterdiğini göstermektedir.

Bir, plan

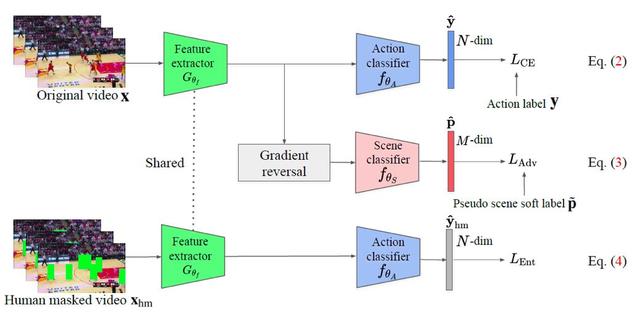

Bu yazıda sahne sapmasını azaltmak için önerilen şema Şekil 3'te gösterilmektedir.

Şekil 3. Sahne sapmasının ortadan kaldırılmasını öğrenmek için video gösteriminin şeması.

Bu şemanın amacı, büyük bir video sınıflandırma görevi için ön eğitim yoluyla özellik çıkarıcının parametrelerini öğrenmektir. Bu süreçte yazarlar üç kayıp fonksiyonu kullandılar. İlk olarak, Mini-Kinetics-200 veri setinde standart bir çapraz entropi kaybı fonksiyonunu iletin

Hareket sınıflandırmasını eğitmek. Sonra kayıpla savaşmak için bir sahne ekleyin

Sahneyi öğrenilmiş temsilden çıkarmayı imkansız kılar. Son olarak, insan vücudunu tespit etmek ve tıkamak için Maske R-CNN kullanarak, tıkanmış bir veri seti oluşturun ve insan vücudu tıkanma kafa karışıklığı kaybını uygulayın.

2. Deney

Bu makale, üç eylem anlama görevi üzerinde deneyler yürütür: eylem sınıflandırması, zamansal eylem konumlandırma ve uzaysal-zamansal eylem tanıma. Kullanılan veri seti aşağıdaki gibidir:

1) Ön eğitim: Mini-Kinetics-200, 80.000 eğitim videosu ve 5.000 doğrulama videosu dahil.

2) Eylem sınıflandırması: UCF-101, 101 eylem kategorisine karşılık gelen 13.320 video içerir; HMDB-51, 51 eylem kategorisine karşılık gelen 6.766 video içerir; Diving48, 48 sürüş eyleminin 18.000 videosunu içerir . İlk iki veri seti için, bu makale önceki çalışmadaki eğitim / test seti bölüm şemasını benimser.

3) Sıralı eylem konumlandırma: THUMOS-14, 20 eylem kategorisi ve zaman damgası dahil.

4) Uzamsal-zamansal eylem tanıma: JHMDB, 21 eylemin 928 videosunu içerir ve tanınacak her eylemin bir etiket kutusu vardır.

Bu makale, bazı önceki modelleri benimser ve önerilen sahne sapması eliminasyon şemasını birleştirir. Eğitim öncesi aşamada, bu makale 3D-ResNet-18 kullanır. Uzamsal-zamansal eylem tanıma için, bu makale VGG-16'ya dayalı bir model kullanır.

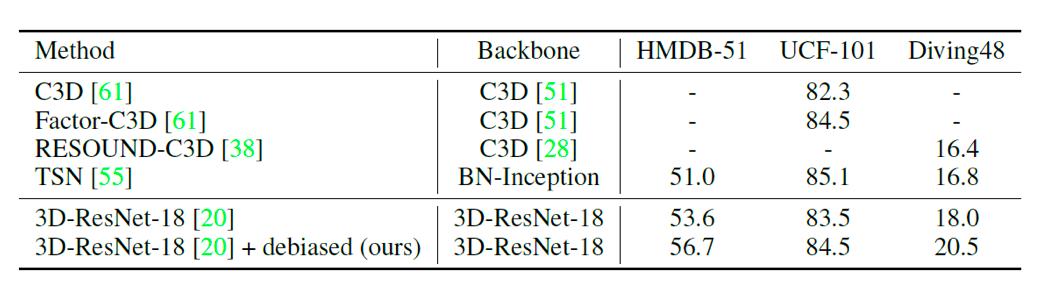

Eylem sınıflandırma görevine ilişkin deneysel sonuçlar Tablo 1'de gösterilmektedir. Sahne sapmalarını gidermek için işlemler eklenerek, üç veri setinin performansı iyileştirildi.

Tablo 1. Eylem sınıflandırma görevinin doğruluğu. UCF-101 ve HMDB-51, farklı bölme yöntemlerinin ortalama sonuçlarını verir.

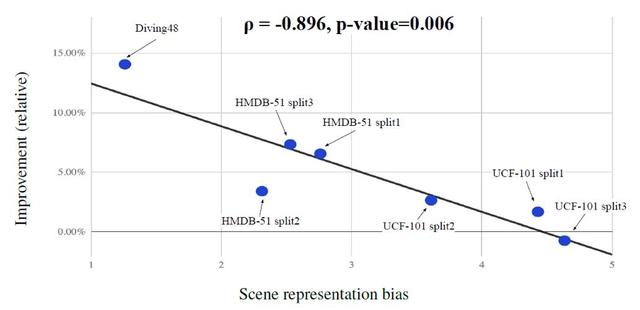

Şekil 4 aynı zamanda göreceli doğruluk artışı ile sahne gösterim sapması arasındaki negatif korelasyonu gösterir. Veri setindeki sahne sapması ne kadar büyükse, önyargı algoritmasının getirdiği iyileştirmenin o kadar küçük olduğu görülebilir.

Şekil 4. Doğruluktaki göreceli artış ile sahne gösterimindeki sapma arasındaki negatif korelasyon. UCF-101 ve HMDB-51'i bölmenin farklı yolları farklı sonuçlara sahip olacaktır.

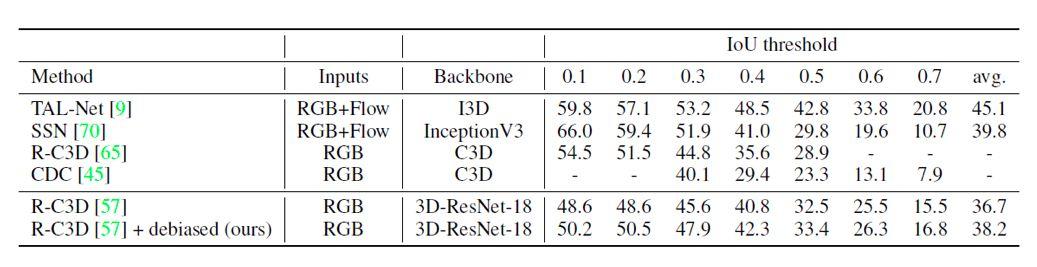

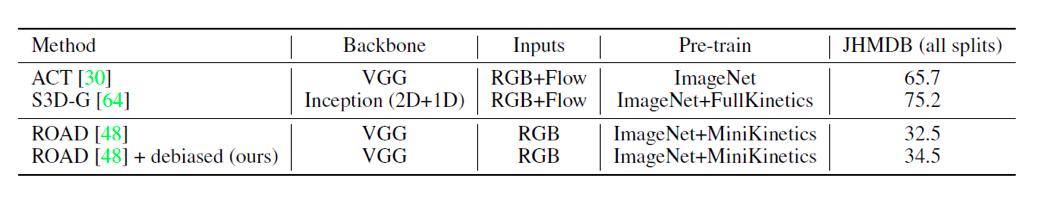

Tablo 2 ve Tablo 3 sırasıyla zamansal eylem konumlandırma ve uzay-zamansal eylem tanıma görevine ilişkin deneysel sonuçları göstermektedir. Bu iki görevde, bu yazıda önerilen sahne sapması giderme şeması, kıyaslama modelinin performansını artırabilir.

Tablo 2. Sıralı eylem konumlandırmanın deneysel sonuçları.

Tablo 3. Uzamsal-zamansal eylem tanımanın deneysel sonuçları.

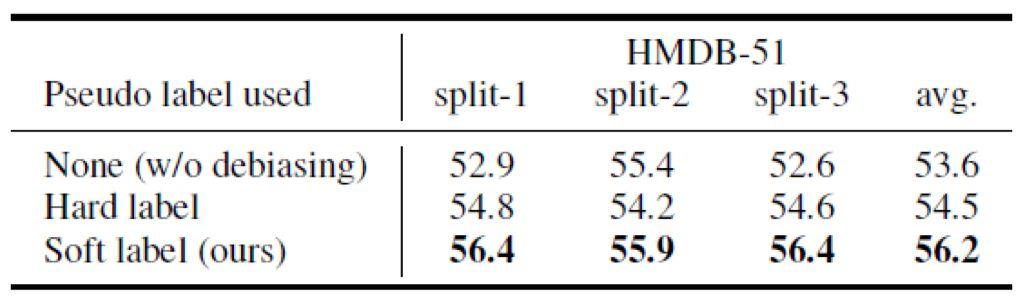

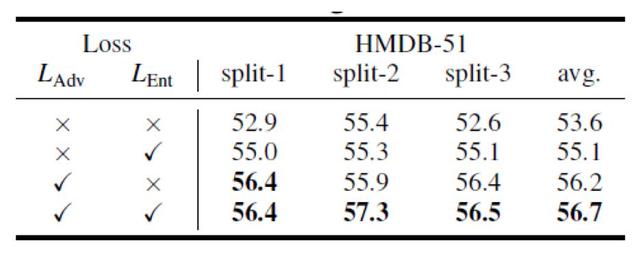

HMDB-51 veri setinde, bu makale sözde sahne etiketleri ve farklı kayıp fonksiyonlarının kombinasyonunu daha da geliştirmektedir. Tablo 4, yumuşak sahne etiketlerinin kullanımının performansı daha iyi artırabileceğini doğrularken, Tablo 5, sahne yüzleşme kaybı ve insan tıkanma karmaşası kaybının aynı anda kullanımının en büyük performans iyileştirmesini sağlayabileceğini doğrulamaktadır.

Tablo 4. Farklı sahne etiketlerinin etkisi.

Tablo 5. Farklı kayıp fonksiyonları kombinasyonlarının etkileri.

Önerilen sahne sapması eliminasyon şemasının etkinliğini daha da doğrulamak için, bu makale Şekil 5'te gösterildiği gibi iki veri seti HMDB-51 ve UCF-101 üzerindeki sınıf aktivasyon eşlemesini analiz eder. Sonuçlar, sahne sapması eliminasyonu kullanılmadığında modelin insan vücudundan çok sahneye odaklanacağını, bu da yanlış sınıflandırmaya yol açacağını ve sahne sapması eliminasyonu kullanıldıktan sonra modelin insan vücudunun kendisine daha fazla dikkat ederek doğru eylem kategorisini verebileceğini göstermektedir.

Şekil 5. İki veri seti HMDB-51 ve UCF-101 üzerinde sınıf aktivasyon eşleme örnekleri. Mavi altı çizili yazı tipi doğru sınıflandırmayı gösterir ve kırmızı yazı tipi yanlış sınıflandırmayı gösterir.

3. Sonuç

Bu makale, önceki araştırmalarda nadiren yer alan bir soruna, yani eylem tanımada arka plan önyargısını ortadan kaldırma sorununa odaklanır ve yeni önerilen iki kayıp tanımını, yani sahne yüzleşme kaybı ve insan tıkanıklığını içeren etkili bir çözüm önerir. Karışıklık kaybı. Üç farklı eylem sınıflandırması, zamansal eylem yerelleştirme ve mekansal-zamansal eylem tanıma görevlerine ilişkin çok sayıda deney, bu makalede önerilen planın etkinliğini göstermektedir.

referans:

Saining Xie, Chen Sun, Jonathan Huang, Zhuowen Tu ve Kevin Murphy. Videonun anlaşılması için uzay-zamansal özellik öğrenimini yeniden düşünme. ECCV, 2018'de.

Kaiming He, Georgia Gkioxari, Piotr Dollár ve Ross Girshick. Mask R-CNN. ICCV'de, 2017.

Khurram Soomro, Amir Roshan Zamir ve Mubarak Shah. UCF101: Vahşi ortamdaki videolardan 101 insan eylemi sınıfından oluşan bir veri kümesi. ArXiv ön baskı arXiv: 1212.0402, 2012.

Hildegard Kuehne, Hueihan Jhuang, Estíbaliz Garrote, Tomaso Poggio ve Thomas Serre. HMDB: İnsan hareketi tanıma için büyük bir video veritabanı. ICCV, 2011.

Yingwei Li, Yi Li ve Nuno Vasconcelos. Resound: Temsil önyargısı olmadan eylem tanımaya doğru. ECCV'de, 2018.

Y.-G. Jiang, J. Liu, A. Roshan Zamir, G. Toderici, I. Laptev, M. Shah ve R. Sukthankar. THUMOS zorluğu: Çok sayıda sınıfla eylem tanıma. Http: // crcv .ucf.edu / THUMOS14 /, 2014.

Hueihan Jhuang, Juergen Gall, Silvia Zuffi, Cordelia Schmid ve Michael J Black. Eylem tanımayı anlamaya doğru. ICCV, 2013.

Kensho Hara, Hirokatsu Kataoka ve Yutaka Satoh. Uzaysal-zamansal 3d cnns, 2d cnns ve imagenet tarihini izleyebilir mi? CVPR, 2018'de.

Gurkirt Singh, Suman Saha ve Fabio Cuzzolin. Tek bir platformda çevrimiçi gerçek zamanlı çoklu uzay-zamansal eylem yerelleştirme ve tahmin. ICCV, 2017'de.

-

- Kulak misafiri! Mobil uygulama, yetkilendirme olmadan çağrıları izleyebilir ve başarı oranı% 90'a kadar çıkmaktadır.

-

- Today's Paper | Hastalık durumu tahmini; ağ budama teknolojisi; haber raporları için manşet yapmak vb.

-

- Doğrudan olay yeri Yurtiçi ve yurtdışındaki giriş ve çıkış havalimanlarında vücut sıcaklığı ölçümü, uçaktaki herkes maske takıyor

-

- Yasadışı sokak satıcıları, şehir yönetimi yetkilisinin tepkisiyle yerde ayaklar altına alındı: bu gerçekten de aşırı

-

- Li Daxiao: Çok naziksiniz! A-hisseleri iyi bir başlangıç yaptı, boşluk bıraktı ve daha yüksek açıldı ve piyasa değeri yarım günde 860 milyar arttı, 3.300'den fazla hisse senedi yükseldi